Med ScraperAPIDu kan glemme alt om CAPTCHA'er, proxyer og blokerede IP-adresser. Med denne API fra web scraping, skal du blot sende en anmodning, og data kommer hurtigt frem til dig. I dag er ScraperAPI blevet taget i brug af tusindvis af brugere.

📌 Her er en tabel, der opsummerer styrker og svagheder ved ScraperAPI ifølge brugerne:

| ✔️ Højdepunkter | ❌ Svage punkter |

|---|---|

| Effektiv omgåelse af CAPTCHA'er | Uklar prissætning |

| Automatisk og effektiv styring af fuldmagter | Lejlighedsvise begrænsninger på gennemstrømning og anmodninger |

| Pålidelig JavaScript-rendering | Ikke egnet til meget store mængder |

| Understøttelse af flere sprog | Avanceret dokumentation kan forbedres |

| Nem integration og enkel API |

Global mening om ScraperAPI

Brugerne opsummerer ScraperAPI med tre ord: hurtig, pålidelig, effektiv.

Ifølge alle anmeldelser indsamlet på Trustpilot, G2 og Capterra har ScraperAPI en gennemsnitlig bedømmelse på:

4,6 ⭐⭐⭐⭐⭐

| 📊 Platform | ⭐ Score ud af 5 |

|---|---|

| Trustpilot | 4,7 |

| G2 | 4,4 |

| Capterra | 4,6 |

✔️ Ofte citerede styrker :

- Pålidelig og effektiv skrabning

- Brugervenlighed og integration

- Enestående kundesupport

- Værdi for pengene

- Specifikke og avancerede funktioner

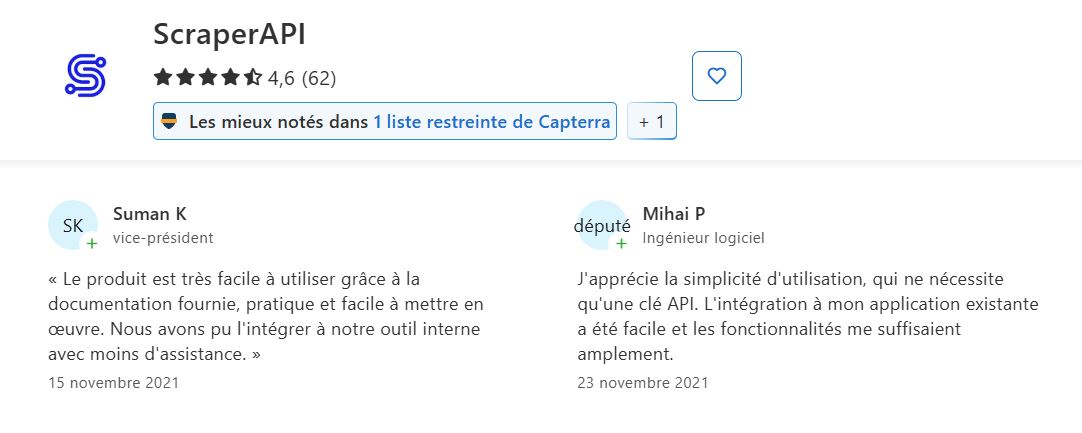

➡️ Ifølge Suman K og Mihai P på Capterra:

“Produktet er meget nemt at bruge takket være den medfølgende dokumentation, som er praktisk og let at implementere…”

“Jeg sætter pris på brugervenligheden, som kun kræver en API-nøgle. Integrationen i min eksisterende applikation var nem, og funktionerne var mere end tilstrækkelige for mig.”

➡️ Akif bekræfter på Trustpilot :

“Deres kundeservice er fremragende…”

➡️ Tilbagevenden af Muhammad H. på G2:

“Det forenkler webscraping ved at håndtere proxyer, CAPTCHAs og browserrendering, så jeg kan fokusere på dataudtræk i stedet for tekniske problemer. API'en integreres perfekt i min eksisterende kode, og hastigheden er imponerende, selv for store projekter.”

❌ Udfordringer og svagheder, som brugerne har bemærket:

- Klarhed over priser og opfattede omkostninger Prissystemet: Brugerne er nogle gange forvirrede over priserne.

- Dokumentation skal forbedres for avanceret funktionalitet.

- Lejlighedsvise problemer med flowbegrænsning/forespørgselsfejl.

- Støtte til kvalitet.

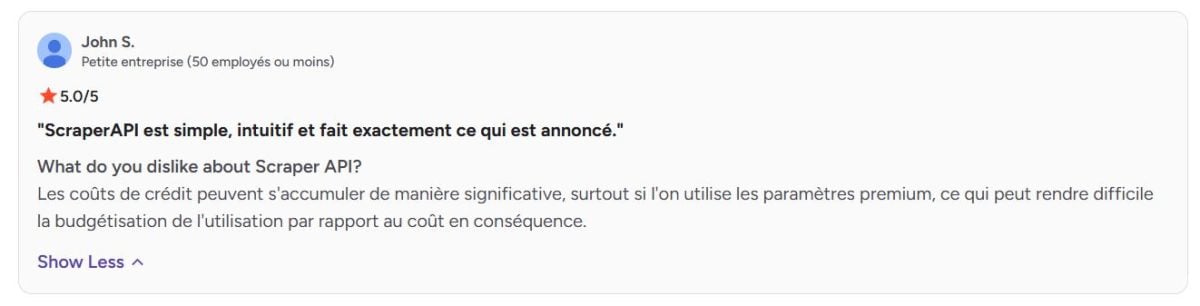

➡️ Ifølge John S. på G2 :

“Kreditomkostningerne kan løbe betydeligt op, især hvis man bruger premium-indstillingerne, hvilket kan gøre det vanskeligt at budgettere brugen i forhold til omkostningerne.”

Udtalelse om de tjenester, der tilbydes af ScraperAPI

Få mere at vide om ScraperAPI's vigtigste tjenester, og hvad brugerne har at sige.

1. Automatisk rotation af proxyer

ScraperAPI har en stor pool af proxyservere, som den automatisk skifter mellem ved hver forespørgsel.

➡️ Ifølge Aditya Pratap Singh på Trustpilot :

“ScraperAPI har revolutioneret mine web scraping-projekter. Før jeg fandt denne tjeneste, kæmpede jeg konstant med CAPTCHA'er og IP-adresseblokeringer. Nu kan jeg fokusere på at bruge dataene i stedet for at kæmpe for at få fat i dem. Proxy-rotationen er problemfri, og jeg sætter pris på den automatiske håndtering af JavaScript-rendering.”

2. Håndtering af bypass-beskyttelse

Værktøjet kan omgå komplekse anti-bot-mekanismer, firewalls, CAPTCHA'er og andre adgangsbegrænsninger, hvilket sikrer en problemfri udtrækning, selv på meget beskyttede websteder.

➡️ Ifølge Arun K.en forskningsmedarbejder:

“Google har formået at blokere programmatiske forespørgsler, selv til ikke-kommercielle formål og selvarkivering, og ScraperAPI har vist sig at være yderst effektiv til at omgå disse blokeringer. Dog er routing af forespørgsler via ScraperAPI meget langsommere end f.eks. via en gratis proxyserver.”

3. JavaScript-rendering

Takket være en integreret headless-browser kan ScraperAPI scrape dynamiske websteder, hvis indhold indlæses via JavaScript.

➡️ Tilbagevenden af Fazt Tech på Trustpilot :

“ScraperAPI har forbedret vores webscraping-processer betydeligt. API'en er nem at integrere og tager sig af de fleste tunge opgaver, såsom IP-adresserotation og proxyhåndtering, hvilket sparer os for værdifuld tid. Den automatiske håndtering af captchas er en stor fordel og forenkler vores dataindsamling betydeligt.”

4. Tilpasning af forespørgsler

HTTP-anmodninger kan tilpasses ved at ændre headers, cookies eller user-agents, hvilket hjælper med at simulere forskellig adfærd og undgå at blive opdaget.

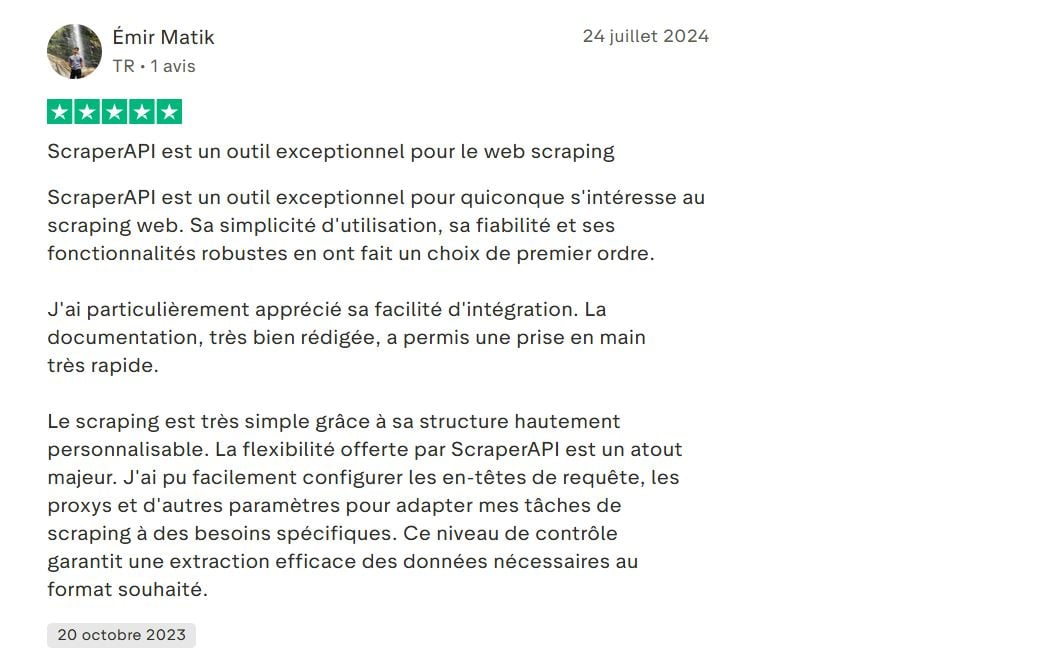

➡️ Her er udtalelsen fra Emir Matik på Trustpilot :

“... Scraping er meget enkelt takket være den meget tilpasselige struktur. Fleksibiliteten i ScraperAPI er en stor fordel. Jeg kunne nemt konfigurere forespørgselsoverskrifter, proxyer og andre indstillinger for at tilpasse mine scraping-opgaver til specifikke behov...”

5. Geolokalisering af fuldmagter

ScraperAPI giver mulighed for at vælge proxys geografiske placering (efter land). Dette er nyttigt til at hente lokaliserede data eller til at teste resultater, der er specifikke for en region.

➡️ Tilbagevenden af Melih Krs på Trustpilot :

“…Desuden var hans håndtering af JavaScript-rendering og IP-geolokalisering uvurderlig…”

6. Dashboard og statistik

Et komplet kontrolpanel gør det muligt at følge brugen, antallet af forespørgsler, succesraten og de resterende kreditter. Dette letter administrationen og optimeringen af scraping.

➡️ Ifølge Tahmeem S. på G2:

“Brugergrænsefladen er ret god, og dataoverførselsfunktionen er meget praktisk. Dashboardet er meget praktisk til at give et overblik over processen. Jeg bruger dette værktøj til webscraping, fordi det hjælper mig med at hente indholdet fra de websider, jeg bruger til min forskning.”

7. Integration og understøttelse af flere sprog

ScraperAPI tilbyder et simpelt REST API, der nemt kan integreres med flere sprog (Python, Node.js, PHP, Java osv.), hvilket gør det nemt at anvende i forskellige miljøer.

➡️ Her er, hvad der står Deni H. på G2:

“Erfaringen med API Scraper er sandsynligvis den, som en udvikler med erfaring i webscraping har, med kendskab til forskellige scraping-teknologier, herunder Python (BeautifulSoup og Selenium), JavaScript (Puppeteer eller Cheerio) og Node.js (Demand og Cheerio) ...”

8. Avancerede funktioner til data

- Asynkron scraping-tjeneste : gør det muligt at sende millioner af forespørgsler asynkront til brug for scraping i meget stor skala.

- Strukturerede data direkte output i JSON eller CSV for at lette databehandlingen.

- DataPipeline Datahentning: komplet automatisering uden kodning til kontinuerlig datahentning.

➡️ Ifølge Alam M.Digital Marketing Manager hos G2 :

“…Det kan automatisk gemme disse oplysninger i Excel- eller CSV-format…”

ScraperAPI : Alternativer

ScraperAPI er ikke den eneste aktør på markedet for webscraping. Der findes flere alternativer, der adskiller sig fra hinanden med hensyn til tilgang, pris og funktionalitet:

- Lyse data den mest omfattende webdataplatform.

- ScrapingBee den største konkurrent til ScraperAPI.

- Oktoparse Visuel tilgang uden kode.

- Apify Scrapper-udviklingsplatform.

| 🌐 Værktøj | 📌 Særlig funktion | 💬Brugeranmeldelser | ⭐Gennemsnitlig vurdering |

|---|---|---|---|

| ScraperAPI | Automatisk rotation af proxyer, JavaScript-rendering, tilpasning | Pålidelig og brugervenlig, men til tider forvirrende med hensyn til prissætning | 4,6 |

| Lyse data | Den mest omfattende platform med førsteklasses proxyer og avanceret datapipeline | Meget kraftfuld og fleksibel, men kompleks at bruge | 4,6 |

| ScrapingBee | Enkel API med JS-rendering og proxy-rotation | Let at integrere og god værdi for pengene, men færre avancerede muligheder | 4,9 |

| Oktoparse | Visuel scraping uden kode, en programmeringsfri tilgang | Ideel til ikke-tekniske brugere, men begrænset til store mængder | 4,4 |

| Apify | Platform til udvikling af brugerdefinerede scrapere | Meget fleksibel og tilpasningsdygtig, men kræver et højt niveau af teknisk ekspertise | 4,8 |

ScraperAPI er en populær og afbalanceret løsning. Selvom flere alternativer tilbyder interessante løsninger tilpasset forskellige profiler, Lyse data forbliver den web-dataplatform den mest komplette og kraftfulde på markedet.

Bright Datas rating er nogle gange lidt lavere på grund af dens Førsteklasses positionering som ikke er egnet til alle brugere.

➡️ Niklas siger Capterra:

“Bright Data er en dyrere tjeneste, men den bedste i sin klasse.”

Ofte stillede spørgsmål

Er ScraperAPI gratis?

ScraperAPI er ikke gratis, men tilbyder en Gratis prøveversion begrænset.

Hvor meget koster ScraperAPI?

ScraperAPI-priserne ligger generelt fra 49$ og 475$ om måneden.

Hvordan fungerer ScraperAPI?

Teknisk set fungerer ScraperAPI som en Mellemliggende mellem din applikation og de websteder, der skal scrapes. Det håndterer automatisk proxy-rotation, IP-styring, JavaScript-rendering og omgåelse af beskyttelse. Værktøjet giver dig mulighed for at Gendan data uden at blokere.

Hvordan bruger jeg ScraperAPI med Python?

Integration med Python er nemt takket være en veldokumenteret REST-API. Du skal blot sende en HTTP-anmodning til ScraperAPIs API-adresse med din API-nøgle og mål-URL'en.

1. Definer ScraperAPI-URL'en med din API-nøgle og mål-URL'en.

importanmodninger

url = "http://api.scraperapi.com"

params = {

'api_key': 'YOUR_API_CLE',

'url': 'https://exemple.com'

}2. Send anmodningen

response = requests.get(url, params=params)3. Vis indholdet af den hentede side

print(svar.tekst)Kan ScraperAPI omgå CAPTCHA'er?

Ja. En af ScraperAPIs styrker er dens evne til automatisk at omgå CAPTCHA og andre anti-bot-systemer.

🔚 Sammenfattende kan man sige, at ScraperAPI er en effektiv løsning til automatisering af online dataindsamling. Men for en mere komplet service, Bright Data er det perfekte valg.

Tøv ikke med at stille spørgsmål i kommentarfeltet og dele dine erfaringer!