Eine exklusive Umfrage des FIAF für Alucare.fr.

Ähnliche Artikel:

Definition von Deepfake :

Deepfake ist eine auf künstlicher Intelligenz basierende Technik zur Bildsynthese, mit der Videos und Audioaufnahmen sehr realistisch erstellt oder verändert werden können. Diese Technik nutzt Methoden des Deep Learning, insbesondere generative antagonistische Netzwerke (GANs), um Bilder und Töne zu überlagern und zu kombinieren. Deepfakes werden häufig eingesetzt, um Inhalte zu produzieren, bei denen Personen, typischerweise Prominente oder öffentliche Figuren, scheinbar Dinge sagen oder tun, die sie nie wirklich gesagt oder getan haben.

Obwohl Deepfakes legitime Anwendungen wie in der Unterhaltung oder der Erstellung von Inhalten haben können (z. B. Candy.ai um seine virtuelle Freundin zu erstellen), werfen sie aufgrund ihres Potenzials für Desinformation, Manipulation und Verletzung der Privatsphäre erhebliche ethische und rechtliche Probleme auf (wie z. B. diese Anwendung zum Ausziehen einer Person). Die Fähigkeit, falsche, aber überzeugende Inhalte zu erstellen, erhöht die Gefahr der Täuschung und hat ernsthafte Auswirkungen auf das Vertrauen in die Medien und Informationen (Beispiele sind die " Deepnude" )

Mit den atemberaubenden Fortschritten der künstlichen Intelligenz ist die Welt heute täglich mit Deepfakes konfrontiert, fiktiven, verblüffend realistischen Bildern und Videos, die zu Unterhaltungszwecken, aber auch im Dienste von Desinformations- oder Verunglimpfungsunternehmen in großem Stil eingesetzt werden können.

Dies wurde kürzlich in Spanien deutlich, als sehr junge Mädchen Opfer von sexuellen Fotomontagen wurden, die über soziale Netzwerke verbreitet wurden.

Sind die Franzosen über dieses Phänomen informiert? Fühlen sie sich in der Lage, damit umzugehen? Fürchten sie es um sich selbst und die Demokratie?

Um es zu messen, Alucare beauftragte das FIAF mit der Befragung von mehr als 2 000 Personen über die Art und Weise, wie wir die Realität wahrnehmen und in Zukunft wahrnehmen werden. Ihre Antworten zeugen insbesondere von der Unsicherheit, in die sie diese gefürchteten technologischen Fortschritte stürzen, von ihrem Wunsch nach einer klaren Identifizierung der betroffenen Inhalte oder auch von ihrer Angst, damit persönlich oder bei den nächsten Präsidentschaftswahlen konfrontiert zu werden.

Das Wahre vom Falschen unterscheiden: eine Schwierigkeit für zwei Drittel der Franzosen

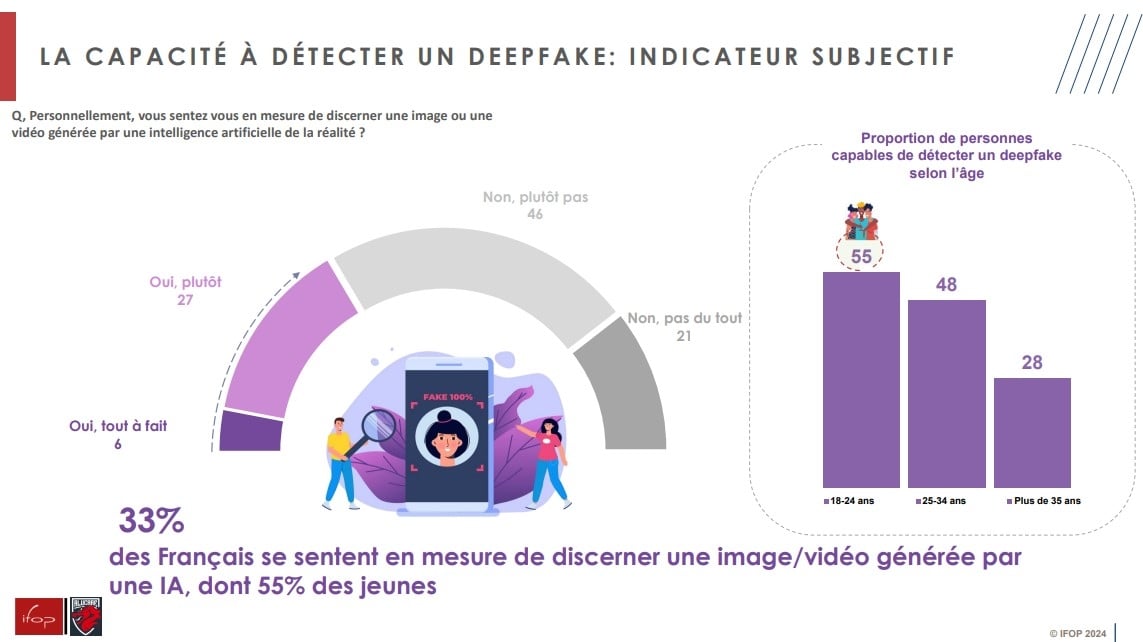

Egal, ob sie nicht wirklich mit den Errungenschaften der künstlichen Intelligenz vertraut sind oder ob sie im Gegenteil um ihre Macht wissen, nur ein Drittel (33%) der Franzosen fühlt sich in der Lage, ein von der KI erzeugtes Bild oder Video zu erkennen. Nur 6% sind sich sicher, was zeigt, wie groß die Unsicherheit in der Bevölkerung über das Thema ist. Mehr als die Hälfte (55%) der 18- bis 24-Jährigen gibt an, dass sie Deepfakes erkennen können, gegenüber 28% bei den über 35-Jährigen und 12% bei den über 65-Jährigen. Männer haben auch viel mehr Vertrauen in ihre Beobachtungsgabe als Frauen: 40% von ihnen glauben, dass sie solche Bilder erkennen können, während es bei den Frauen nur 28% sind..

Test: Manche Bilder sind irreführender als andere

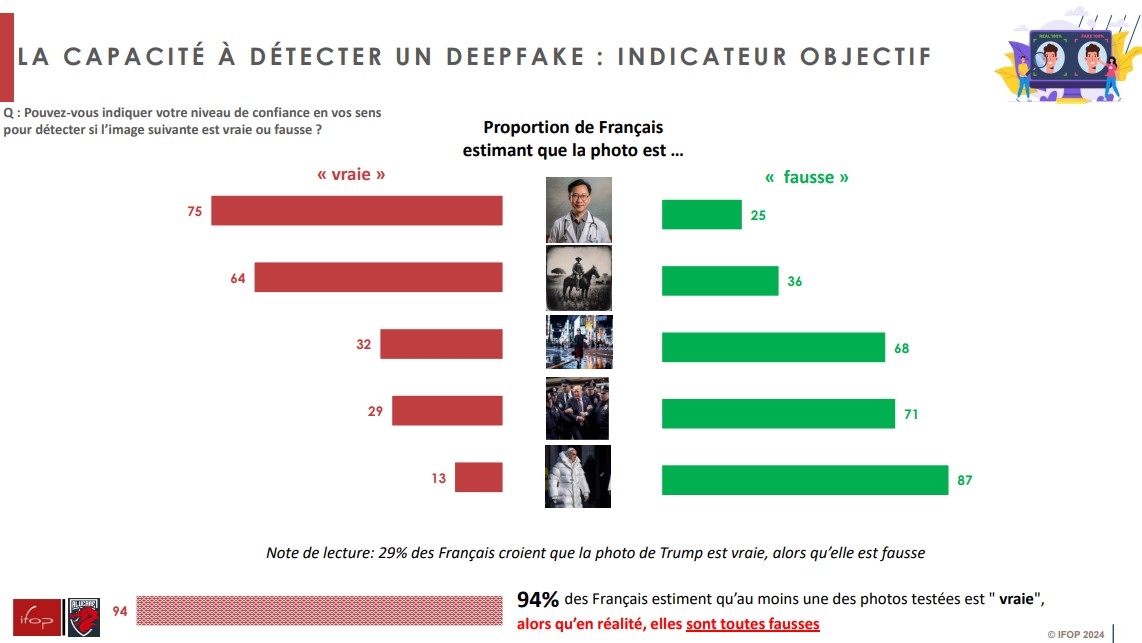

Der vom FIAF vorgeschlagene Test ist ein gutes Beispiel dafür, wie schwierig es ist, ein von künstlicher Intelligenz erzeugtes Bild von einem Foto zu unterscheiden, das im wirklichen Leben aufgenommen wurde. Die Teilnehmer wurden gebeten, fünf Bilder zu betrachten und anzugeben, welche Bilder ihrer Meinung nach von der KI erzeugt wurden und welche nicht. In Wirklichkeit waren jedoch alle gezeigten Bilder "falsch".

So täuschte das besonders realistische Porträt eines Arztes drei Viertel (75%) der BefragtenFast zwei Drittel (64%) hielten ein altes Foto eines Mannes auf einem Pferd für wahr, das typisch für Aufnahmen vom Anfang des letzten Jahrhunderts war, aber vollständig von der KI zusammengestellt wurde. Im Gegensatz dazu glaubten nur 32% an die Echtheit des Bildes einer Frau, die durch die Straßen von Tokio läuft. Dieses Bild wurde von der Firma Open AI zur Ankündigung der Veröffentlichung ihres Sora-Videogenerators in großem Stil verbreitet. Der ehemalige Präsident Donald Trump, der regelmäßig wegen seiner Auseinandersetzungen mit der US-Justiz in die Schlagzeilen gerät, wurde von mehreren Polizisten umringt dargestellt. Dieses "Foto" wurde von mehr als einem von vier Franzosen (29%) für glaubwürdig gehalten, wobei Frauen (32%) etwas häufiger an seine Echtheit glaubten als Männer (27%). Das Bild von Papst Franziskus in einer weißen Daunenjacke, das vor einigen Monaten in den sozialen Netzwerken veröffentlicht wurde, täuschte nur 13% der Befragten. Schließlich glaubten 94% der Befragten, dass mindestens eines der Klischees, die ihnen vorgelegt wurden, der Wahrheit entsprach.

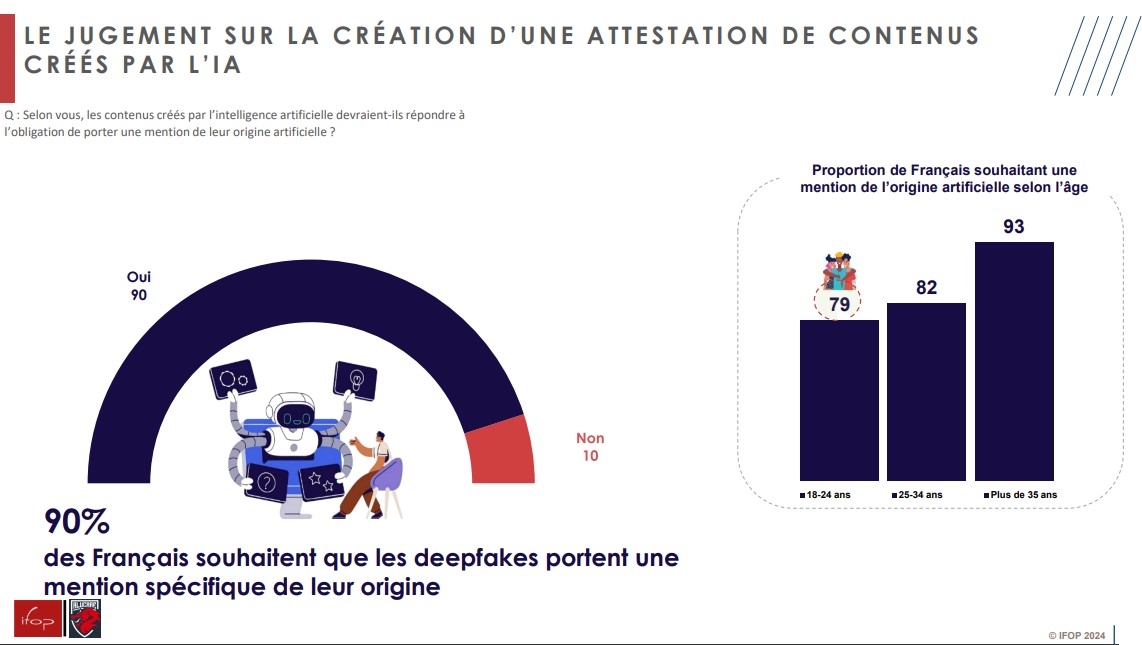

90% von Franzosen für eine Ursprungsbezeichnung

Sie warnte offensichtlich vor den Risiken der Desinformation, die mit der Verbreitung realistischer, von der KI erzeugter Bilder einhergehen, Die überwältigende Mehrheit (90%) der Franzosen spricht sich für einen Hinweis zur Identifizierung von Deepfakes aus. als künstlich geschaffen angesehen werden. Diese Erwartung ist bei den über 35-Jährigen (93% befürworten dies) stärker ausgeprägt als bei ihren jüngeren Altersgenossen (79% bei den 18- bis 24-Jährigen).

Nicht immer einfach zu unterscheidende Hinweise

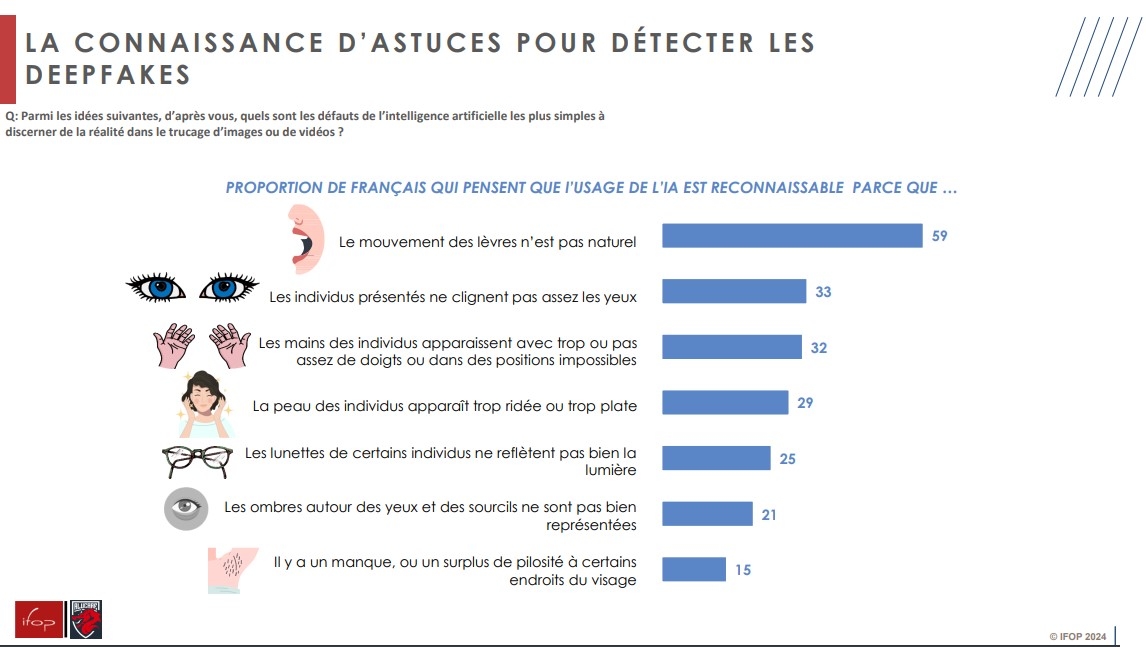

Innerhalb weniger Jahre, für manche sogar innerhalb weniger Monate, haben die Werkzeuge der künstlichen Intelligenz beeindruckende Fortschritte gemacht, um ihre visuellen Produktionen immer realistischer zu gestalten. Dennoch gibt es immer noch Details, die ihre wahre Natur verraten können, auch wenn die Franzosen bei vielen von ihnen vorsichtig bleiben. Die nicht ganz natürliche Bewegung der Lippen einer Person, die in einem Video spricht, ist für 59% der Franzosen ein Hinweis, der ihnen recht einfach zu erkennen scheint.. Ebenso ist die Tatsache, dass die abgebildeten Personen nicht oft genug blinzeln, für ein Drittel (33%) der Franzosen ein guter Indikator.

Ähnlich viele 32% weisen auf die nachgewiesenen, aber immer weniger aktuellen Schwierigkeiten von bildgebenden KIs hin, Hände korrekt zu reproduzieren. Faltenreiche oder zu flache Haut (29%), Brillen, die das Licht nicht richtig reflektieren (25%), ungenaue Schatten um die Augen (21%) und fehlende Gesichtsbehaarung (15%) werden als potenzielle Warnsignale angesehen. Dennoch hält nur eine Minderheit der Befragten diese für leicht zu erkennen.

Teilweise Wissen über Deepfakes

Von der Sängerin Taylor Swift, die Anfang des Jahres Opfer pornografischer Deepfakes wurde, über die falsche Ankündigung der Kapitulation der ukrainischen Truppen durch Präsident Volodimir Zelensky bis hin zu Ursula von der Leyens jüngster, ebenfalls gefälschter Erklärung zu den bevorstehenden Europawahlen - es gibt immer mehr KI-generierte Videos, in denen reale Personen zu sehen sind. In Almendralejo (Spanien) wurden im vergangenen September fast 30 Mädchen im Alter von 11 bis 17 Jahren mit Deepfakes beworfen, die sie nackt zeigten.

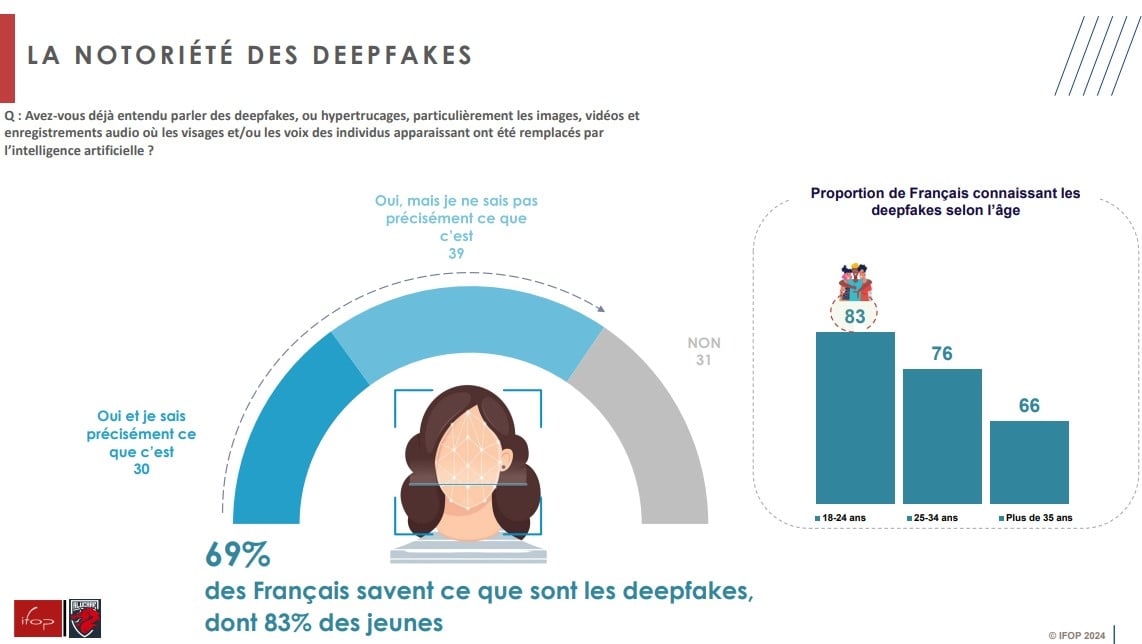

Angesichts dieses wachsenden und beunruhigenden Phänomens geben fast sieben von zehn Franzosen (69%) an, schon einmal von Deepfakes gehört zu haben, aber nur 30% wissen genau, worum es sich dabei handelt. Wiederum sind es die jüngeren Generationen, die am meisten über diese Bewegung wissen: 83% der 18- bis 24-Jährigen (gegenüber 66% der über 35-Jährigen) wissen davon und 50% (gegenüber 15% der über 65-Jährigen) haben eine klare Vorstellung davon.. Der Unterschied zwischen Frauen und Männern ist übrigens nicht zu vernachlässigen: Während 24% der ersteren klar wissen, was Deepfakes sind, sind es 37% der letzteren.

Jeder dritte Franzose hat schon einmal Fake News verbreitet

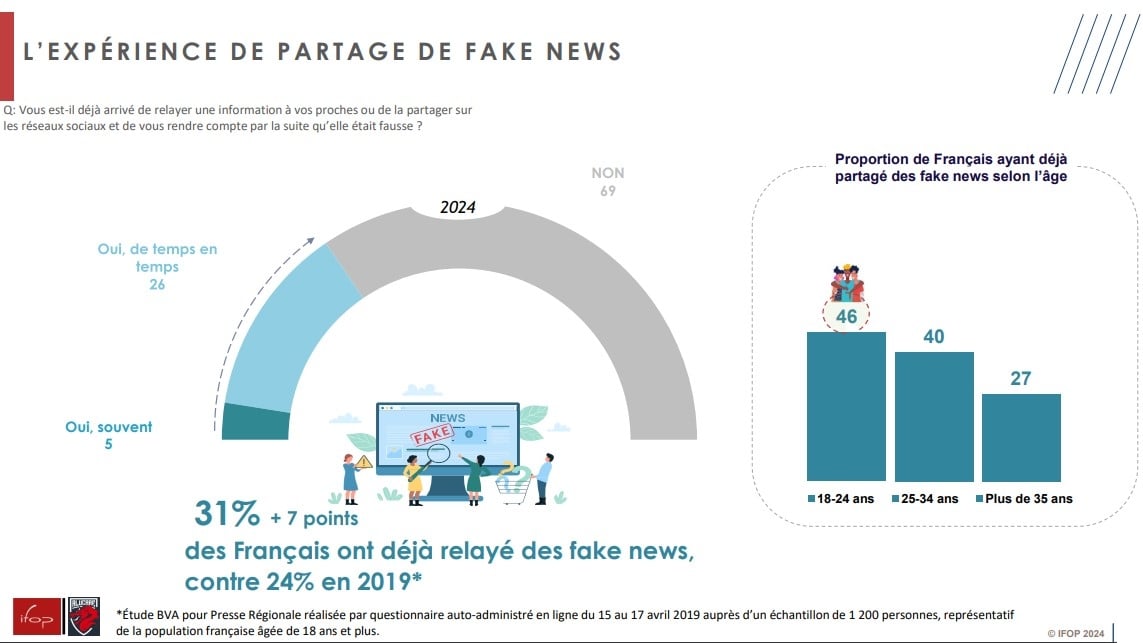

Deepfakes und Fake News gehören zur selben Familie, die Desinformation und Manipulation der öffentlichen Meinung nährt. Ein Teil der Franzosen gibt zu, dass sie an dieser Manipulation beteiligt sind, auch ohne es zu wissen. So, 31% der Befragten (7 Prozentpunkte mehr als in einer BVA-Studie von 2019) haben in ihrem Umfeld schon einmal Informationen weitergegeben, die sich später als falsch herausstellten.Die jungen Menschen taten dies häufiger (46%) als die anderen Altersgruppen. Im Gegensatz dazu gaben mehr als drei Viertel der über 50-Jährigen an, noch nie etwas in dieser Richtung unternommen zu haben.

Eine manchmal zweifelhafte moralische Akzeptanz

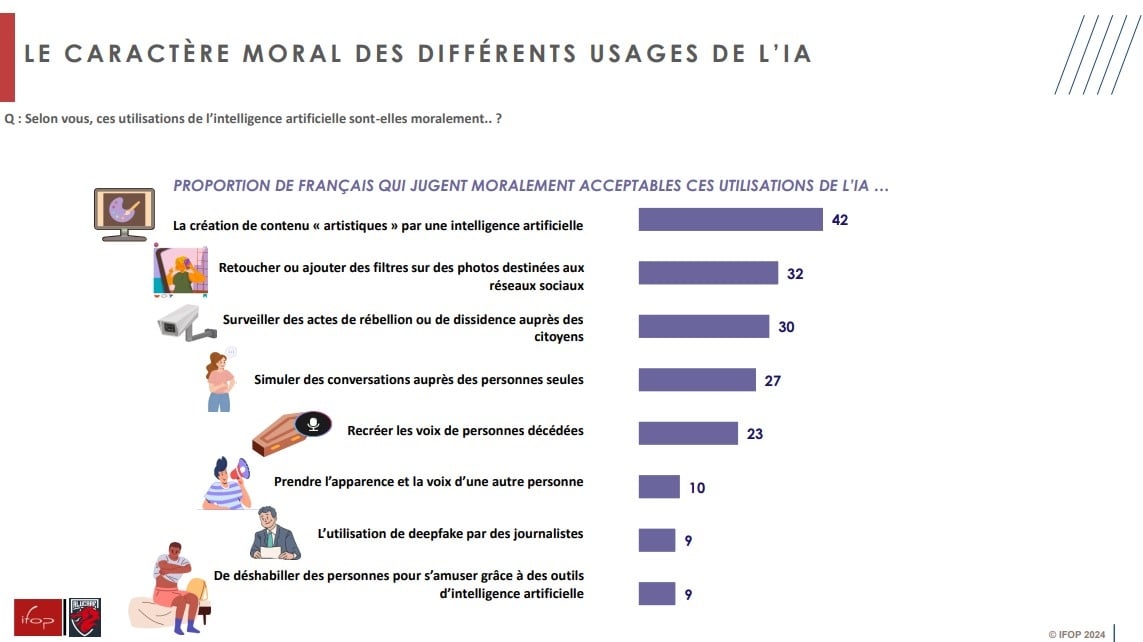

Wie wir gesehen haben, bietet die künstliche Intelligenz heute vielfältige Ressourcen für Bilder, Videos oder auch das Klonen von Stimmen. Die meisten Franzosen und Französinnen halten keine der in der Umfrage vorgestellten KI-Anwendungen für moralisch vertretbar. Am besten akzeptiert sind jeweils die Erstellung "künstlerischer" Inhalte durch eine künstliche Intelligenz (42% halten dies für moralisch vertretbar) und die Bearbeitung von Fotos in sozialen Netzwerken mit Filtern (32%).

Erstaunlicher - und sicherlich auch besorgniserregender - ist Folgendes 30% der Befragten sind damit einverstanden, dass KI zur Überwachung von rebellischen oder abweichenden Handlungen von Bürgern eingesetzt werden sollte.. In der Altersgruppe der unter 35-Jährigen sind es 34% und in der Altersgruppe der über 35-Jährigen 29%, die diese Praxis für akzeptabel halten. Große generations- und geschlechtsspezifische Unterschiede bestehen auch bei der Frage, ob man Menschen mithilfe von KI zum Spaß ausziehen darf. Während nur 9% der Franzosen insgesamt von einer solchen Nutzung nicht schockiert sind, steigt die Zahl bei den unter 35-Jährigen auf 17% (und bis zu 26% der Männer in dieser Altersgruppe) gegenüber 6% bei den Älteren. Ebenso halten 13% der Männer die künstliche Entblößung für moralisch vertretbar, während es bei den Frauen nur 4% sind.

13% der unter 25-Jährigen wurden Opfer von Deepfakes

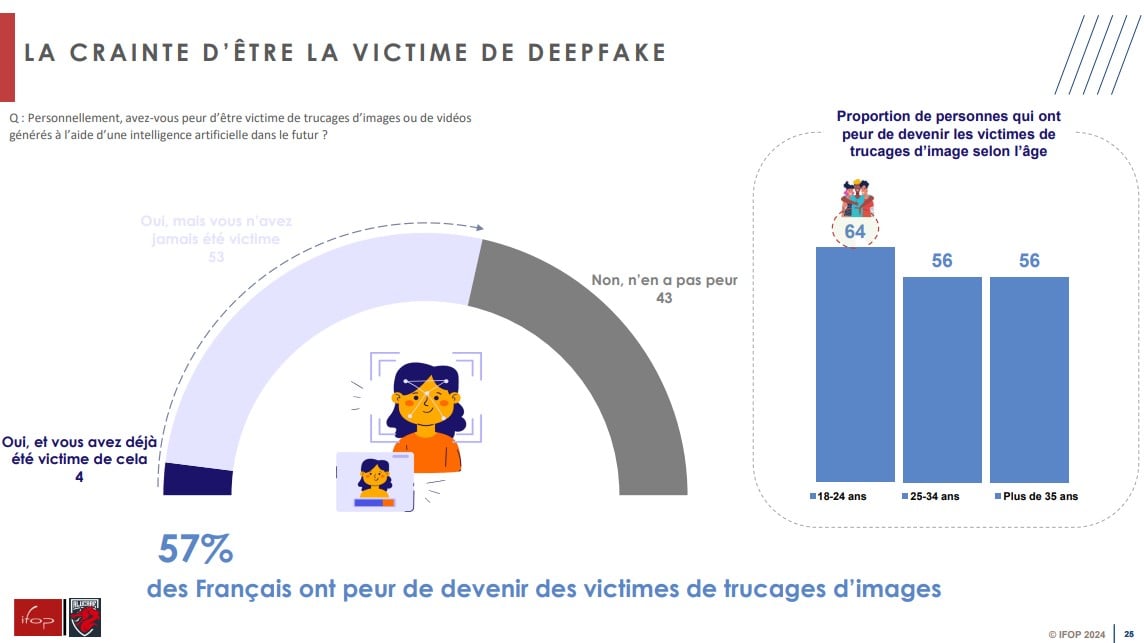

Im Bewusstsein der Verbreitung von Werkzeugen, die die Möglichkeit bieten, Deepfakes leicht zu erstellen, Mehr als die Hälfte der Befragten (57%) äußerte die Befürchtung, selbst Opfer zu werden, was bei 4% von ihnen und 13% der unter 25-Jährigen bereits der Fall war.. Während die Jüngsten tatsächlich am meisten besorgt sind (64% der 18- bis 24-Jährigen befürchten falsche Bilder, die sie betreffen), sind die anderen Altersgruppen nicht wirklich gelassener, da 56% der über 25-Jährigen dies ebenfalls berichten.

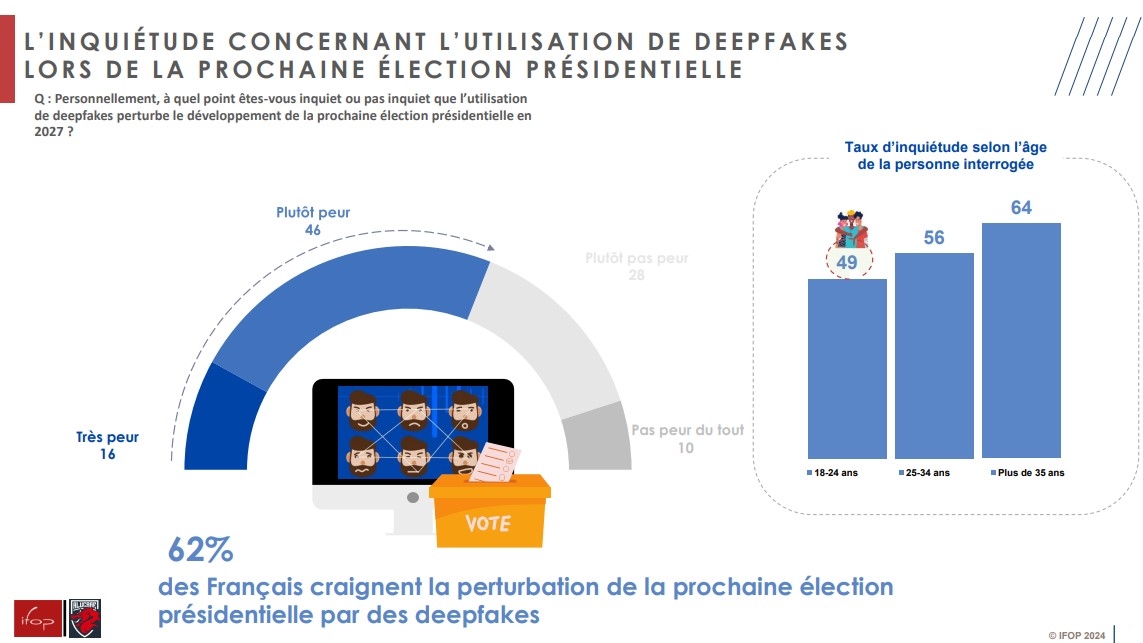

Eine Bedrohung für die Präsidentschaftswahlen?

Die Franzosen fürchten nicht nur sich selbst, sondern auch, dass solche Praktiken die nächsten Präsidentschaftswahlen beeinträchtigen könnten. Mehr als sechs von zehn Franzosen (62%) sind besorgt, dass Deepfakes die Wahlen im Jahr 2027 stören könnten. 16% geben an, dass sie große Angst davor haben. Weniger als die Hälfte (49%) der unter 25-Jährigen fürchtet sich davor, während 70% der über 65-Jährigen dies befürchten.

Umfrage durchgeführt von IFOP für Alucare.fr vom 5. bis 8. März 2024 mittels eines selbst ausgefüllten Fragebogens bei einer Stichprobe von 2 191 Personen, repräsentativ für die französische Bevölkerung ab 18 Jahren, darunter 551 junge Menschen unter 35 Jahren.

In einem Kasten

Deepfakes im SREN-Gesetzentwurf

Am Dienstag, den 26. März, wird eine Gemischte Paritätische Kommission, in der Abgeordnete der Nationalversammlung und des Senats vertreten sind, den Gesetzentwurf zur Sicherung und Regulierung des digitalen Raums (SREN) prüfen. Das von der Regierung eingebrachte und von den Abgeordneten am 17. Oktober 2023 verabschiedete Gesetz soll die mit der täglichen Nutzung des Internets verbundenen Risiken für Einzelpersonen und Unternehmen absichern. Er sieht Bestimmungen in sehr unterschiedlichen Bereichen vor, wie z. B. den Online-Schutz von Minderjährigen, den Schutz der Bürger im digitalen Umfeld, die Wahrung des Wettbewerbs in der Datenwirtschaft und die Stärkung der Regulierung des digitalen Sektors. Bei seinen Beratungen im Herbst fügte der Senat zwei Artikel hinzu, die die Veröffentlichung von Hypertrucking (Deepfakes) ohne Zustimmung und die Veröffentlichung von Deepfakes mit sexuellem Inhalt unter Strafe stellen. Die Strafen könnten bis zu zwei Jahre Haft und 60.000 € Geldstrafe betragen.