En eksklusiv IFOP-afstemning for Alucare.fr.

IFOP-undersøgelsen :

Med de fantastiske fremskridt inden for kunstig intelligens konfronteres verden nu dagligt med deepfakes, fiktive billeder og videoer, der er forbløffende realistiske og kan bruges til underholdningsformål, men også til storstilede desinformations- og smædekampagner.

Mens mange offentlige personer regelmæssigt udsættes for misbrug af deres image, er anonyme personer ikke immune, som det for nylig blev vist i Spanien i sagen om meget unge piger, der var ofre for seksuelle fotomontager, der blev lagt ud på sociale netværk.

Er franskmændene bevidste om dette fænomen? Føler de sig i stand til at håndtere det? Frygter de det for sig selv og for demokratiet?

For at måle det, Alucare bad IFOP om at undersøge over 2.000 mennesker. om den omvæltning, der er i gang i den måde, vi opfatter og vil opfatte virkeligheden på i fremtiden. Deres svar afspejler den usikkerhed, som de bliver kastet ud i af disse formidable teknologiske fremskridt, deres ønske om en klar identifikation af det pågældende indhold og deres frygt for at blive konfronteret med det i en personlig sammenhæng eller under det næste præsidentvalg.

At skelne mellem sandhed og løgn: et problem for to tredjedele af franskmændene

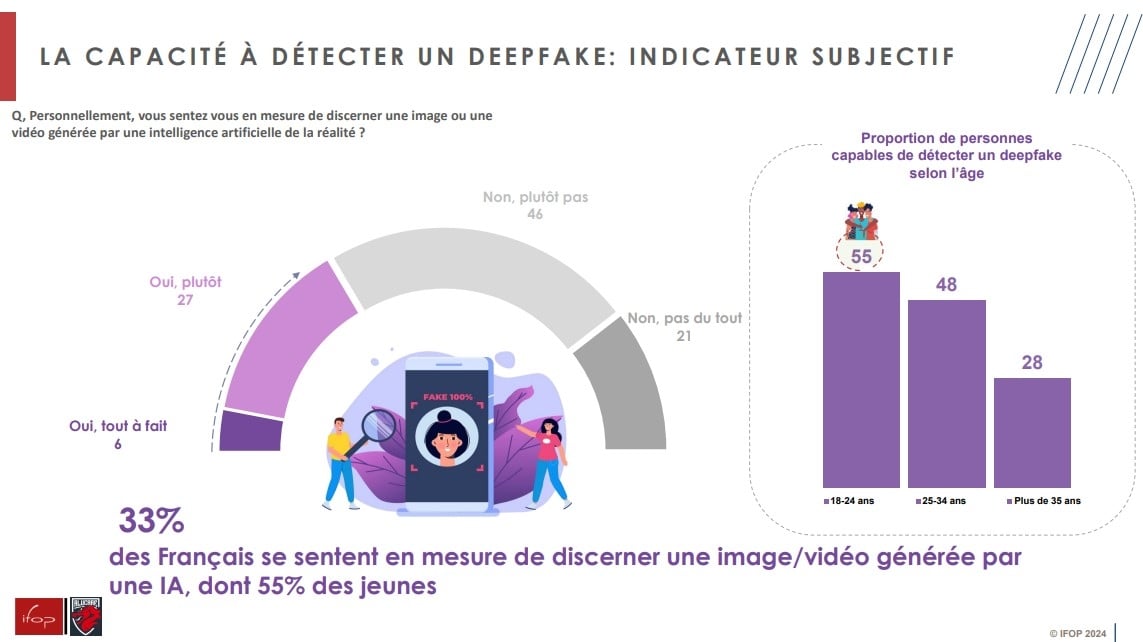

Om de ikke er helt med på, hvad kunstig intelligens er for en størrelse, eller om de tværtimod ved, hvor kraftfuld den kan være, Kun en tredjedel (33%) af franskmændene føler sig i stand til at genkende et billede eller en video genereret af AI.. Kun 6% er sikre på dette, hvilket viser den usikkerhed, der hersker i befolkningen om emnet. De unge er generelt mere fortrolige med nye teknologier end de ældre, og det er dem, der siger, at de er bedst i stand til at spotte en deepfake: mere end halvdelen (55%) af de 18-24-årige siger, at det er tilfældet, sammenlignet med 28% af de over 35-årige og 12% af de over 65-årige. Mænd er også meget mere sikre end kvinder på deres observationsevne, idet 40% af dem mener, at de kan se sådanne billeder sammenlignet med 28% af kvinderne..

Test: Nogle billeder er mere misvisende end andre

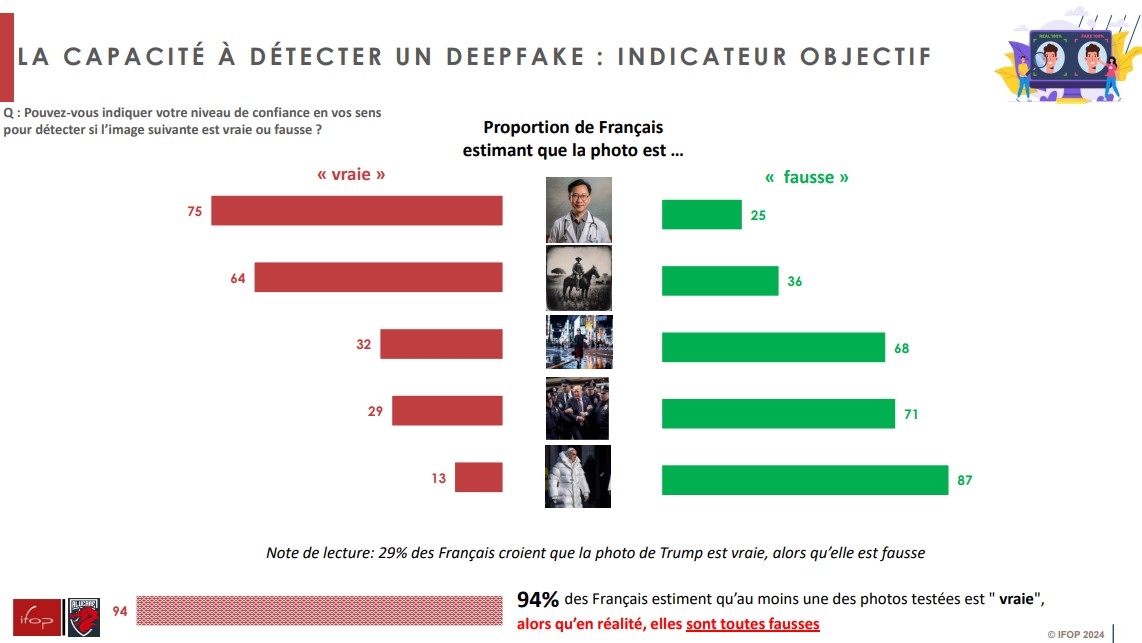

Den test, som IFOP har foreslået, illustrerer perfekt, hvor svært det er at skelne et billede, der er produceret af kunstig intelligens, fra et foto, der er taget i virkeligheden. Deltagerne blev bedt om at undersøge fem billeder og angive, hvilke de troede var eller ikke var genereret af AI. Men i virkeligheden var alle de præsenterede billeder "falske".

Det særligt realistiske portræt af en læge narrede tre fjerdedele (75%) af respondenterne.Næsten to tredjedele (64%) troede, at et gammelt foto af en mand til hest, som er typisk for fotos taget i begyndelsen af forrige århundrede, var sandt, men udelukkende sammensat af AI. På den anden side troede kun 32% på sandheden i et billede af en kvinde, der går i Tokyos gader, et billede, som Open AI brugte meget til at annoncere udgivelsen af sin Sora-videogenerator. Den tidligere præsident Donald Trump, som jævnligt er i nyhederne for sine sammenstød med det amerikanske retssystem, blev vist omgivet af flere politibetjente. Dette "foto" blev fundet troværdigt af mere end hver fjerde franskmand (29%), med lidt flere kvinder (32%) end mænd (27%), der troede på dets ægthed. Endelig narrede billedet af pave Frans i en hvid dunjakke, som blev offentliggjort på sociale netværk for et par måneder siden, kun 13% af de adspurgte. Endelig troede 94% af respondenterne på sandheden i mindst én af de klichéer, de blev udsat for.

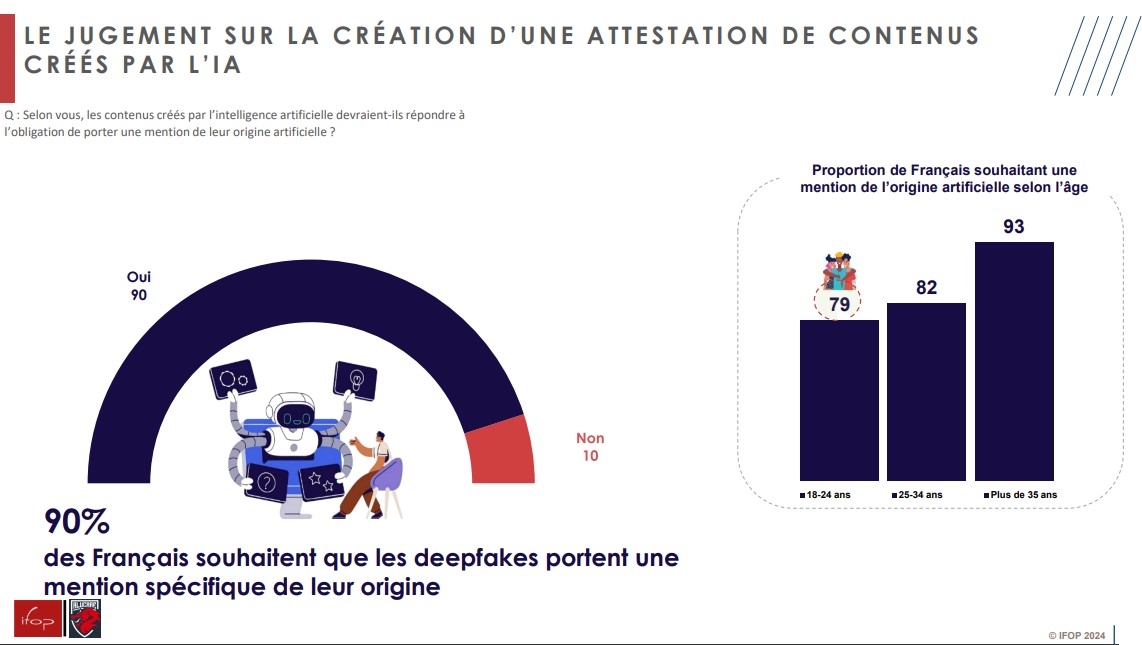

90% af den franske for en angivelse af oprindelse

Der blev tydeligvis advaret om risikoen for misinformation i forbindelse med udbredelsen af helt realistiske billeder produceret af kunstig intelligens, Et overvældende flertal (90%) af franskmændene går ind for en erklæring, der identificerer deepfakes. som værende kunstigt skabt. Denne forventning er højere blandt de over 35-årige (93% er for) end blandt deres yngre modstykker (79% blandt 18-24-årige).

Ledetråde, der ikke altid er lette at få øje på

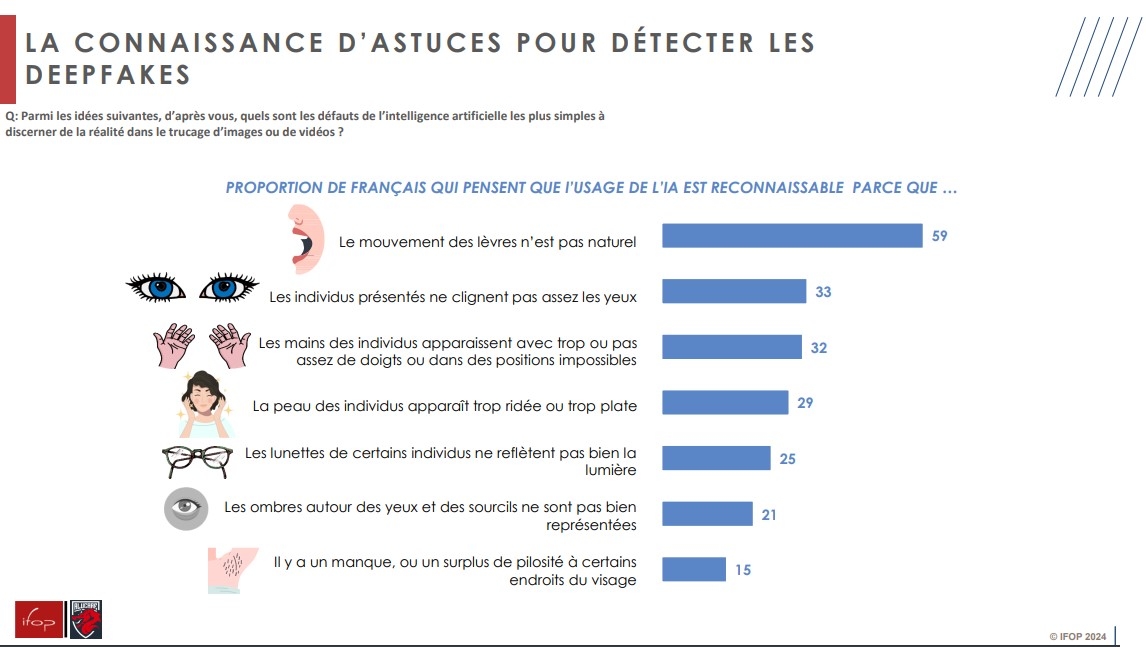

I løbet af et par år, eller endda et par måneder for nogle, har værktøjer til kunstig intelligens gjort imponerende fremskridt med at gøre deres visuelle produktioner stadig mere realistiske. Men der er stadig detaljer, som kan afsløre deres sande natur, selv om franskmændene stadig er forsigtige med mange af dem. For 59% af franskmændene er den unaturlige bevægelse af læberne hos en person, der taler i en video, et spor, som de mener er ret let at få øje på.. På samme måde er det faktum, at de repræsenterede personer ikke blinker ofte nok, en god indikator for en tredjedel (33%) af franskmændene.

I et lignende forhold peger 32% på de kendte, men mindre og mindre aktuelle vanskeligheder, som billedgenererende AI har med at gengive hænder korrekt. Rynket eller for flad hud (29%), briller, der ikke reflekterer lyset korrekt (25%), skygger omkring øjnene, der ikke er præcise nok (21%) eller mangel på hår i visse områder af ansigtet (15%) er alle ufuldkommenheder, der betragtes som potentielle advarselsskilte. Det er dog kun et mindretal af respondenterne, der mener, at de er lette at få øje på.

Delvis viden om deepfakes

Fra sangerinden Taylor Swift, som blev offer for pornografiske deepfakes tidligere i år, til præsident Volodimir Zelenskys falske meddelelse om de ukrainske troppers overgivelse og Ursula von der Leyens nylige, også falske, udtalelse om det kommende valg til Europa-Parlamentet, bliver AI-genererede videoer med rigtige mennesker stadig mere udbredte. Og det er ikke kun berømtheder og politikere, der er ramt: I september sidste år blev næsten 30 unge piger mellem 11 og 17 år i Almendralejo i Spanien udsat for deepfakes, der viste dem nøgne.

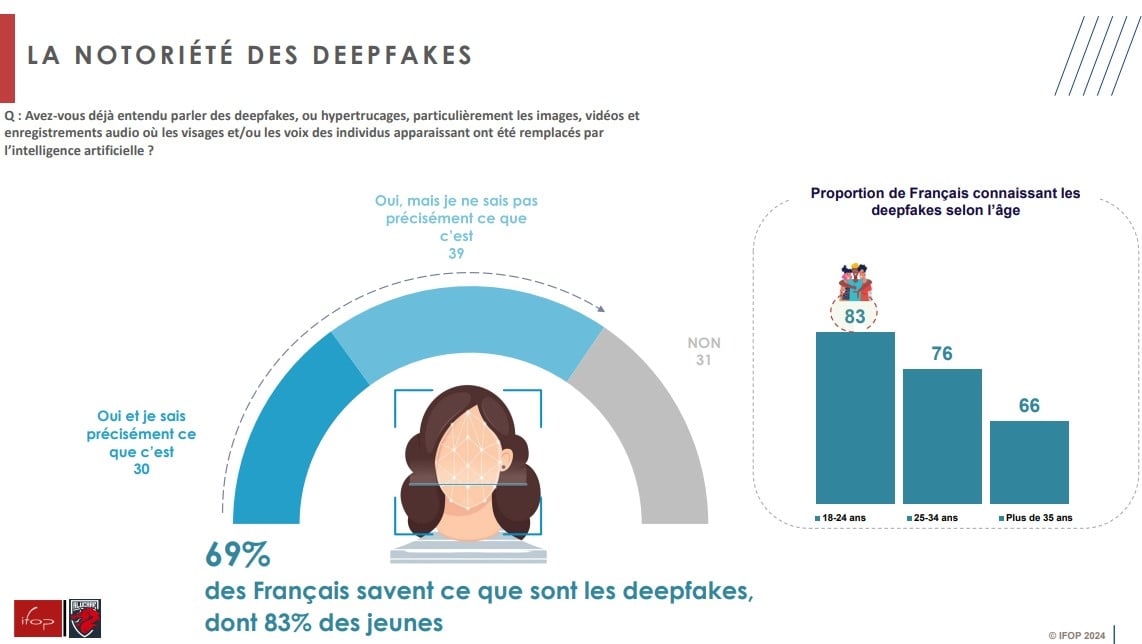

I lyset af dette voksende og bekymrende fænomen angiver næsten 7 ud af 10 franskmænd (69%), at de allerede har hørt om deepfakes, men kun 30% ved præcis, hvad det drejer sig om. Igen er det de yngre generationer, der er mest bekendt med denne bevægelse: 83% af de 18-24-årige (sammenlignet med 66% af de over 35-årige) er bevidste om det, og 50% (sammenlignet med 15% af de over 65-årige) har en klar vision om det.. Forskellen mellem kvinder og mænd er ikke ubetydelig: Mens 24% af kvinderne tydeligvis ved, hvad deepfakes er, gør 37% af mændene.

Hver tredje franskmand har allerede spredt falske nyheder

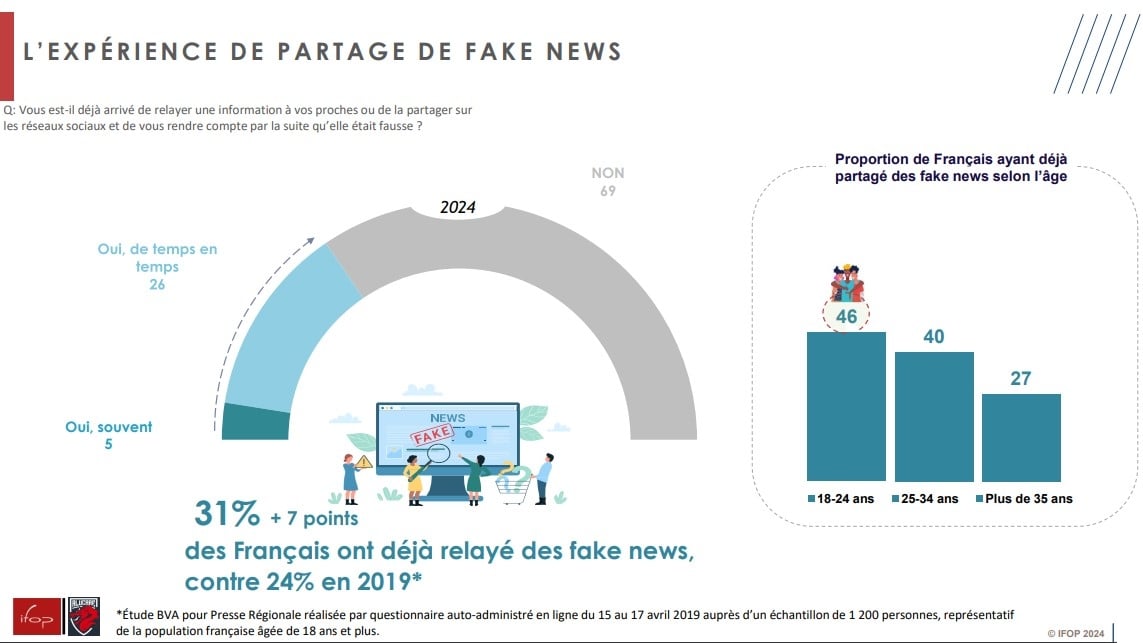

Deepfakes og fake news hører til den samme familie, som giver næring til misinformation og manipulation af den offentlige mening. En manipulation, som nogle franskmænd indrømmer at have deltaget i, selv ubevidst. Og sådan er det, 31% af de adspurgte (7 point mere end i en BVA-undersøgelse fra 2019) har allerede videregivet oplysninger til deres omgivelser, som senere viste sig at være falske.Unge var mere tilbøjelige til at have gjort det (46%) end andre aldersgrupper. På den anden side siger mere end tre fjerdedele af de over 50-årige, at de aldrig har gjort det.

En til tider tvivlsom moralsk accept

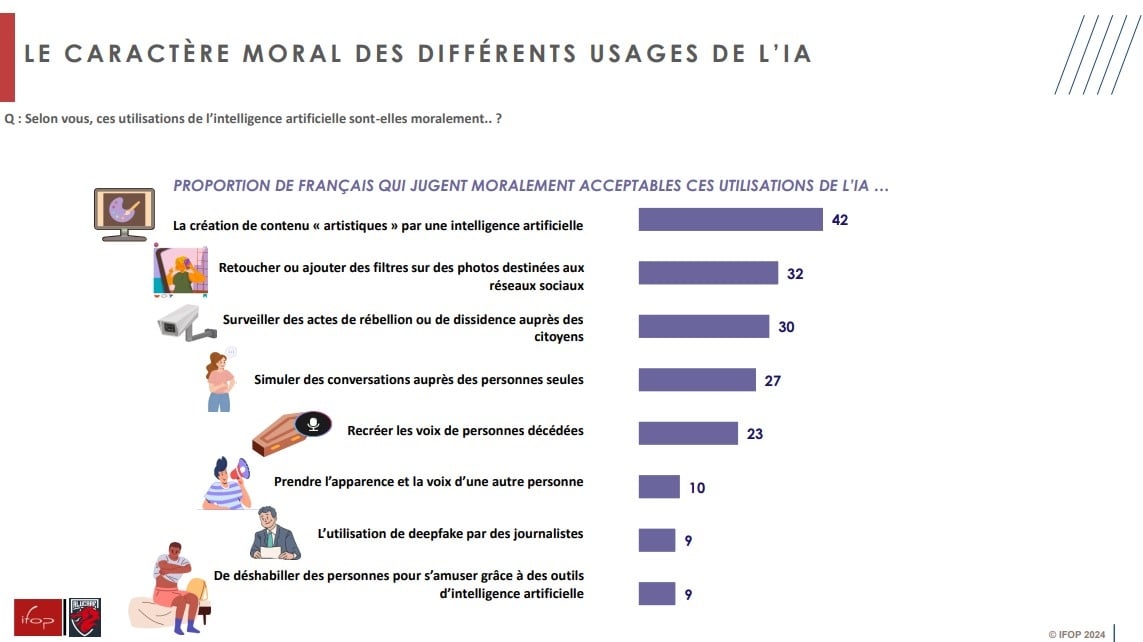

Som vi har set, giver kunstig intelligens i dag et væld af ressourcer i form af billeder, video og endda kloning af stemmer. Af de forskellige anvendelser af kunstig intelligens, som blev præsenteret for dem i denne undersøgelse, er der ingen, som flertallet af franskmændene finder moralsk acceptable. De bedst accepterede er skabelsen af "kunstnerisk" indhold ved hjælp af kunstig intelligens (42% mener, at dette er moralsk acceptabelt) og retouchering af fotos på sociale netværk ved hjælp af filtre (32%).

Mere overraskende - og bestemt mere bekymrende - er det faktum, at 30% af de adspurgte var enige i, at AI bør bruges til at overvåge oprør eller uenighed blandt borgerne.. I dette tilfælde er de unge mindre kritiske end de ældre: 34% af de under 35-årige finder denne praksis acceptabel, sammenlignet med 29% af de over 35-årige. Der er også store generations- og kønsforskelle, når det kommer til at klæde folk af ved hjælp af AI for sjov. Mens kun 9% af franskmændene som helhed ikke er chokerede over en sådan brug, stiger tallet til 17% blandt de under 35-årige (og så mange som 26% af mændene i denne aldersgruppe) sammenlignet med 6% blandt deres ældre. På samme måde mener 13% af mændene, at denne kunstige eksponering er moralsk acceptabel, sammenlignet med 4% af kvinderne.

13% af unge under 25 år er blevet ofre for deepfakes

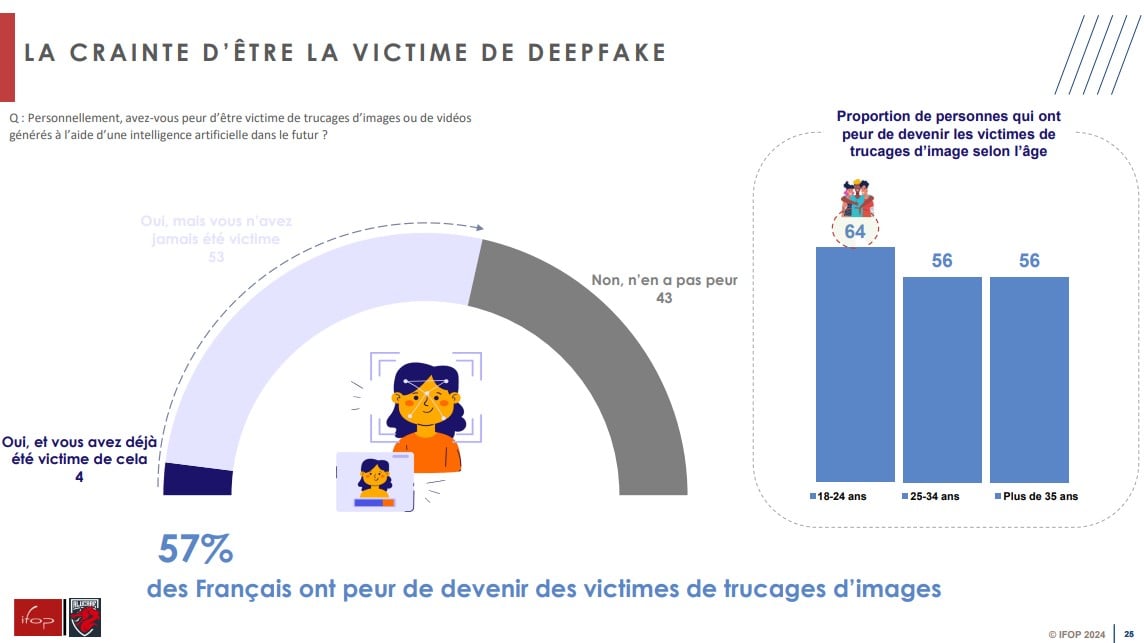

Vi er opmærksomme på den udbredte brug af værktøjer, der gør det nemt at skabe deepfakes, Mere end halvdelen af respondenterne (57%) udtrykte frygt for, at de også ville blive ofre, hvilket allerede var sket for 4% af dem og 13% af de unge under 25 år.. Mens de yngste aldersgrupper faktisk er de mest bekymrede (64% af de 18-24-årige frygter falske billeder af dem), er de andre aldersgrupper ikke rigtig mere rolige, idet 56% af de over 25-årige også udtrykker bekymring.

En trussel mod præsidentvalget?

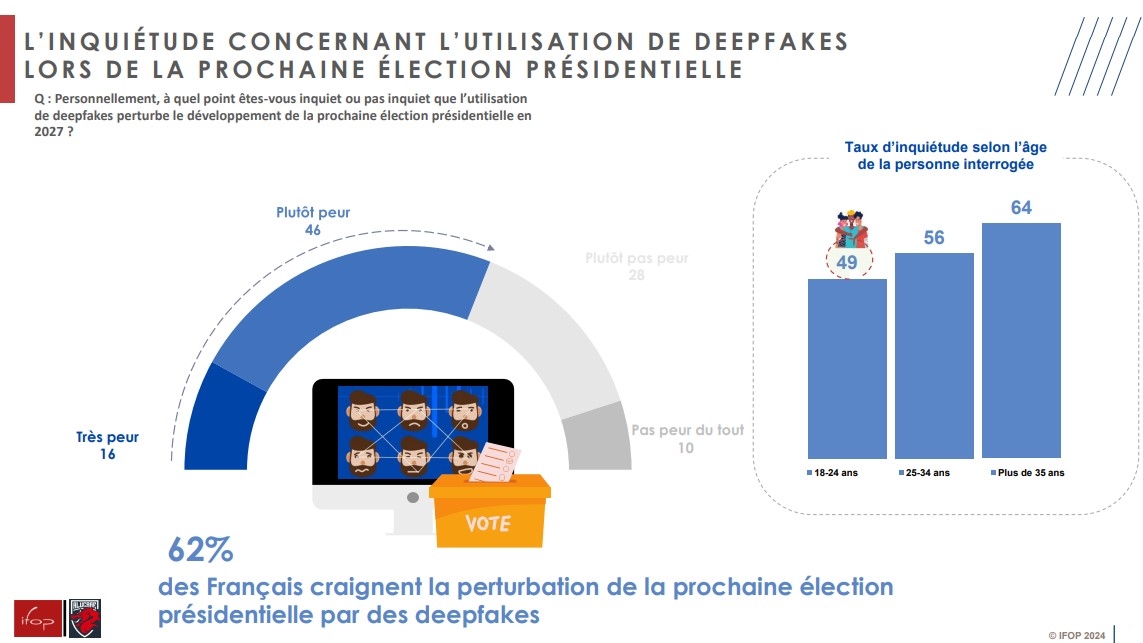

Mens de frygter dem for sig selv, er franskmændene også bange for, at sådanne praksisser kan blande sig i det næste præsidentvalg, især da kunstige intelligensværktøjer helt sikkert vil blive endnu mere kraftfulde inden da. Mere end 6 ud af 10 franskmænd (62%) siger, at de er bekymrede for, at deepfakes kan forstyrre afstemningen i 2027, herunder 16%, der siger, at de er meget bange. De unge er mere bekymrede end gennemsnittet for misbrug af deres eget image, men de er meget mindre bekymrede for den potentielle effekt af falske billeder under valgkampen: mindre end halvdelen (49%) af de under 25-årige er bange for dette, mens 70% af de over 65-årige frygter det.

Undersøgelse udført af IFOP for Alucare.fr fra 5. til 8. marts 2024 ved hjælp af selvadministreret spørgeskema blandt en stikprøve på 2.191 personer, der er repræsentative for den franske befolkning på 18 år og derover, herunder 551 unge under 35 år.

I æsken

Deepfakes i SREN-forslaget

Tirsdag den 26. marts vil en blandet kommission bestående af folkevalgte medlemmer af Nationalforsamlingen og Senatet behandle lovforslaget om sikring og regulering af det digitale rum (SREN). Lovforslaget, der er fremsat af regeringen og vedtaget af deputerede den 17. oktober 2023, har til formål at mindske risiciene ved daglig brug af internettet for enkeltpersoner og virksomheder. Det indeholder bestemmelser inden for meget forskellige områder, såsom onlinebeskyttelse af mindreårige, beskyttelse af borgere i det digitale miljø, overholdelse af konkurrencereglerne i dataøkonomien og styrkelse af reguleringen af det digitale område. Under sit arbejde i efteråret tilføjede senatet to artikler, der straffer offentliggørelse uden samtykke af deepfakes og offentliggørelse af deepfakes af seksuel karakter.. Straffen kan være op til to års fængsel og en bøde på 60.000 euro.