Uma sondagem IFOP exclusiva para o Alucare.fr.

A sondagem do IFOP :

Com os progressos impressionantes realizados no domínio da inteligência artificial, o mundo é agora confrontado diariamente com deepfakes, imagens e vídeos fictícios que são extremamente realistas e podem ser utilizados para fins de entretenimento, mas também para campanhas de desinformação e difamação em grande escala.

Embora muitas figuras públicas sejam regularmente alvo de apropriação indevida da sua imagem, as pessoas anónimas não estão imunes, como ficou recentemente demonstrado em Espanha no caso de raparigas muito jovens que foram vítimas de montagens fotográficas de cariz sexual publicadas nas redes sociais.

Estarão os franceses conscientes deste fenómeno? Sentem-se capazes de o enfrentar? Temem-no para si próprios e para a democracia?

Para o medir, O Alucare encomendou ao IFOP um inquérito a mais de 2.000 pessoas. sobre a reviravolta em curso na forma como percepcionamos e percepcionaremos a realidade no futuro. As suas respostas reflectem a incerteza em que são mergulhados por estes formidáveis avanços tecnológicos, o seu desejo de identificação clara dos conteúdos em causa e o seu receio de serem confrontados com eles pessoalmente ou durante as próximas eleições presidenciais.

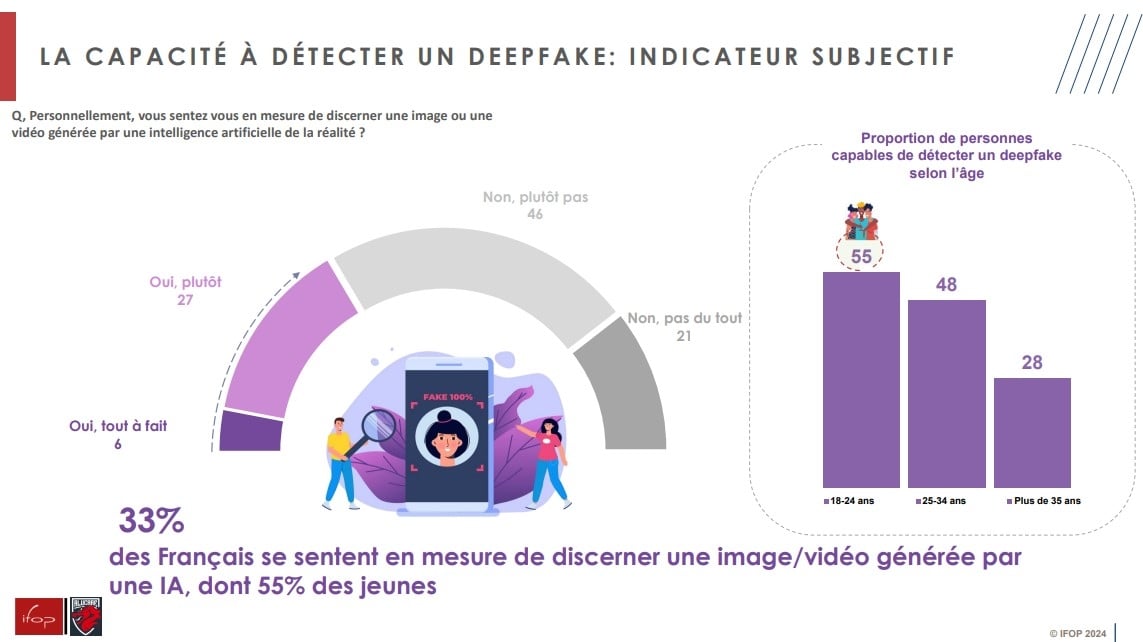

Distinguir a verdade da mentira: um problema para dois terços dos franceses

Quer não estejam realmente a par das proezas da inteligência artificial ou, pelo contrário, saibam o quão poderosa ela pode ser, apenas um terço (33%) dos franceses se sente capaz de detetar uma imagem ou um vídeo gerado pela IA. Apenas 6% têm a certeza disso, o que demonstra a incerteza que reina na população sobre o assunto. Geralmente mais à vontade com as tecnologias emergentes do que os mais velhos, os jovens são os que se dizem mais capazes de detetar um deepfake: mais de metade (55%) dos jovens entre os 18 e os 24 anos afirmam que é esse o caso, em comparação com 28% dos maiores de 35 anos e 12% dos maiores de 65 anos. Os homens também estão muito mais confiantes do que as mulheres nos seus poderes de observação, com 40% deles a acreditarem que conseguem detetar tais imagens, em comparação com 28% das mulheres..

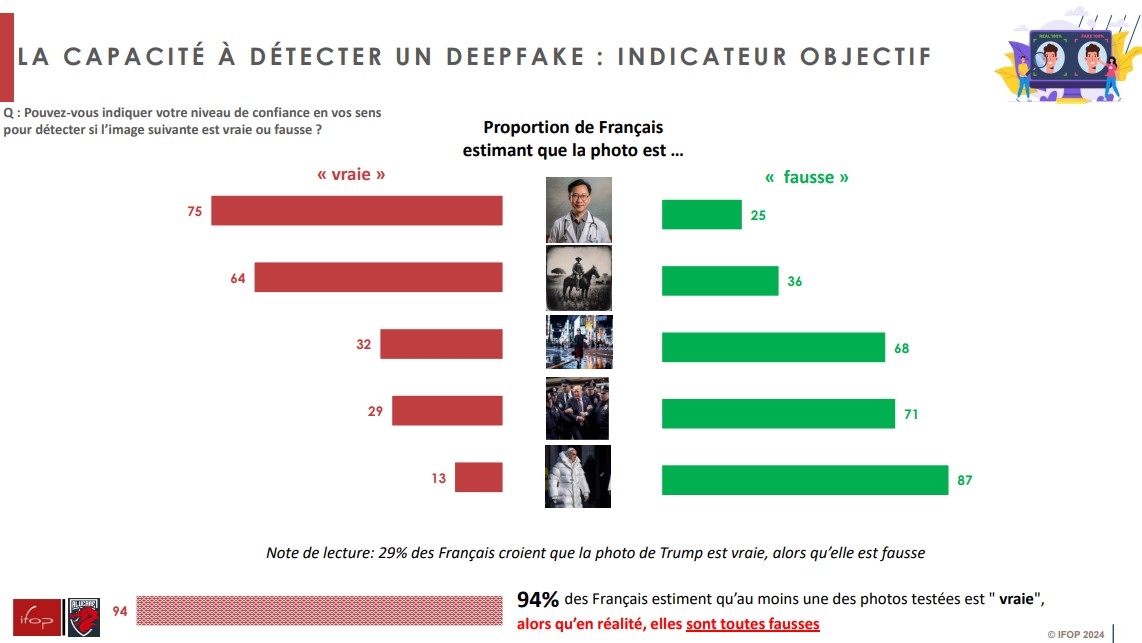

Teste: algumas imagens são mais enganadoras do que outras

O teste proposto pelo IFOP ilustra perfeitamente a dificuldade de distinguir uma imagem produzida por inteligência artificial de uma fotografia tirada na vida real. Solicitados a examinar cinco imagens, os participantes foram convidados a indicar quais achavam que eram ou não geradas pela IA. Mas, na realidade, todas as imagens apresentadas eram "falsas".

O retrato particularmente realista de um médico enganou três quartos (75%) dos inquiridos.Quase dois terços (64%) acreditavam que uma fotografia antiga de um homem a cavalo, típica das fotografias tiradas no início do século passado, era verdadeira, mas inteiramente composta por IA. Por outro lado, apenas 32% acreditavam na veracidade de uma imagem de uma mulher a caminhar nas ruas de Tóquio, uma imagem amplamente utilizada pela Open AI para anunciar o lançamento do seu gerador de vídeo Sora. O antigo Presidente Donald Trump, que é regularmente objeto de notícias devido aos seus problemas com a justiça americana, aparece rodeado por vários agentes da polícia. Esta "fotografia" foi considerada credível por mais de um francês em cada quatro (29%), com um pouco mais de mulheres (32%) a acreditarem na sua autenticidade do que homens (27%). Por fim, a imagem do Papa Francisco com um casaco de penas branco, amplamente divulgada nas redes sociais há alguns meses, enganou apenas 13% dos inquiridos. Por último, 94% dos inquiridos acreditavam na veracidade de pelo menos um dos clichés submetidos ao seu escrutínio.

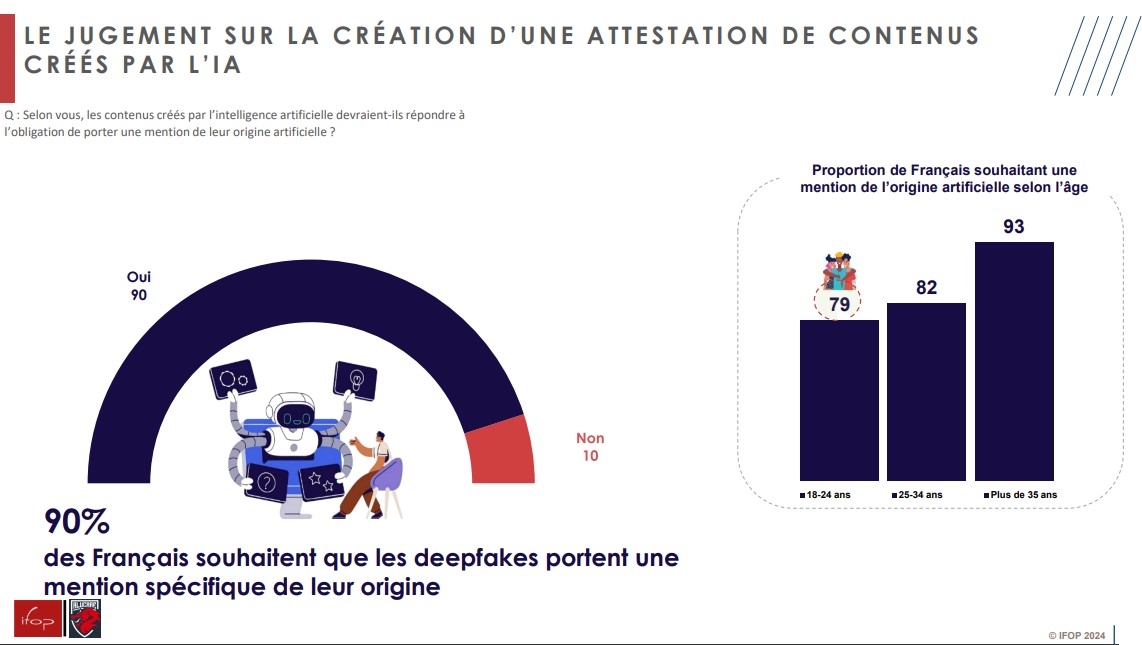

90% do francês para uma menção de origem

Obviamente, alertou para os riscos de desinformação inerentes à propagação de imagens totalmente realistas produzidas pela IA, a esmagadora maioria (90%) dos franceses é a favor de uma declaração que identifique os deepfakes como tendo sido criado artificialmente. Esta expetativa é mais elevada entre as pessoas com mais de 35 anos (93% são a favor) do que entre os seus homólogos mais jovens (79% entre os 18-24 anos).

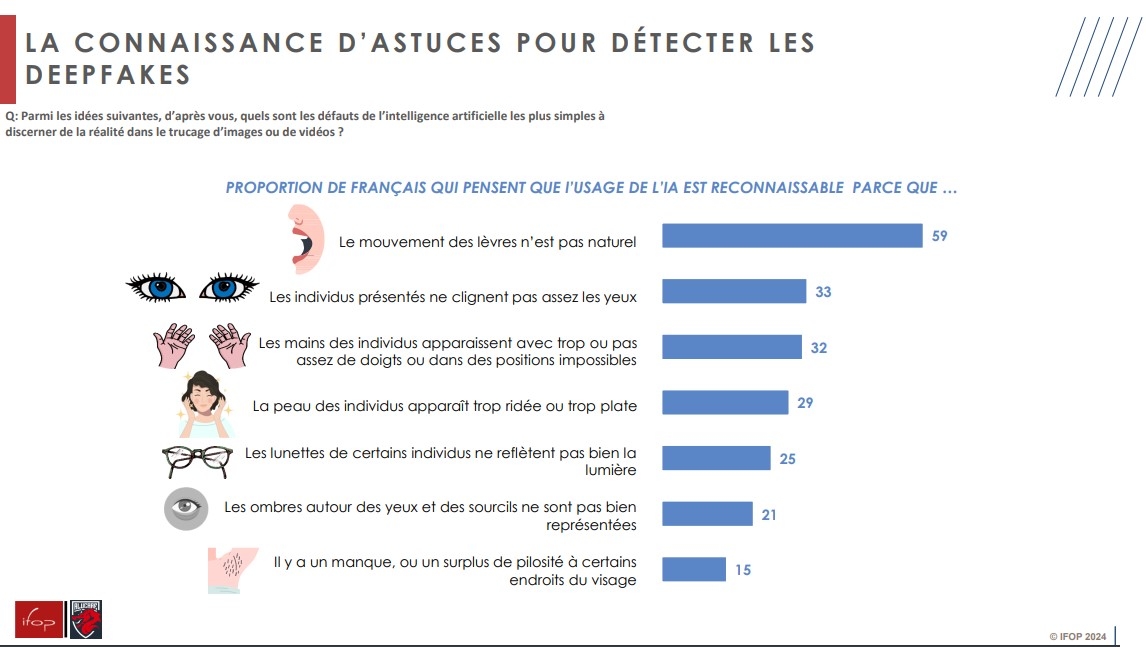

Pistas que nem sempre são fáceis de detetar

No espaço de alguns anos, ou mesmo de alguns meses para alguns, as ferramentas de inteligência artificial fizeram progressos impressionantes para tornar as suas produções visuais cada vez mais realistas. No entanto, certos pormenores podem ainda trair a sua verdadeira natureza, mesmo que os franceses se mantenham prudentes em relação a muitos deles. Para 59% dos franceses, o movimento não natural dos lábios de uma personagem que fala num vídeo é uma pista que consideram bastante fácil de detetar.. Do mesmo modo, o facto de os indivíduos representados não piscarem os olhos com frequência suficiente é um bom indicador para um terço (33%) dos franceses.

Numa proporção semelhante, 32% apontam para as dificuldades, conhecidas mas cada vez menos actuais, da IA geradora de imagens em reproduzir corretamente as mãos. A pele enrugada ou demasiado lisa (29%), os óculos que não reflectem corretamente a luz (25%), as sombras à volta dos olhos que não são suficientemente precisas (21%) ou a falta de pêlos em certas zonas do rosto (15%) são todas imperfeições consideradas como potenciais sinais de alerta. No entanto, apenas uma minoria dos inquiridos considera que estas são fáceis de detetar.

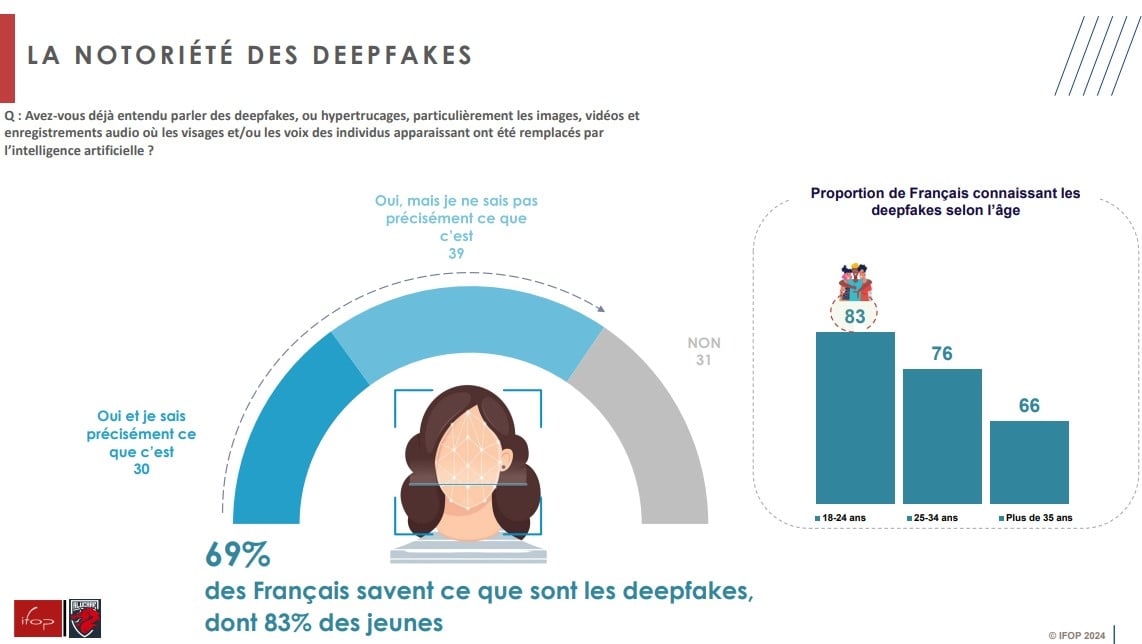

Conhecimento parcial de deepfakes

Desde a cantora Taylor Swift, que foi vítima de deepfakes pornográficos no início deste ano, ao falso anúncio do Presidente Volodimir Zelensky sobre a rendição das tropas ucranianas, passando pela recente declaração, também falsa, de Ursula von der Leyen sobre as próximas eleições europeias, os vídeos gerados por IA com pessoas reais estão a multiplicar-se. E não são apenas as celebridades e os políticos que são afectados: em setembro passado, em Almendralejo, Espanha, cerca de trinta jovens raparigas com idades compreendidas entre os 11 e os 17 anos foram alvo de deepfakes que as mostravam nuas.

Perante este fenómeno crescente e preocupante, cerca de 7 em cada 10 franceses (69%) afirmam já ter ouvido falar de deepfakes, mas apenas 30% sabem exatamente do que se trata. Mais uma vez, são as gerações mais jovens que estão mais a par deste movimento: 83% de jovens entre os 18 e os 24 anos (contra 66% de pessoas com mais de 35 anos) estão conscientes do facto e 50% (contra 15% de pessoas com mais de 65 anos) têm uma visão clara do mesmo.. A diferença entre homens e mulheres não é insignificante: enquanto 24% das mulheres sabem claramente o que são deepfakes, 37% dos homens sabem-no.

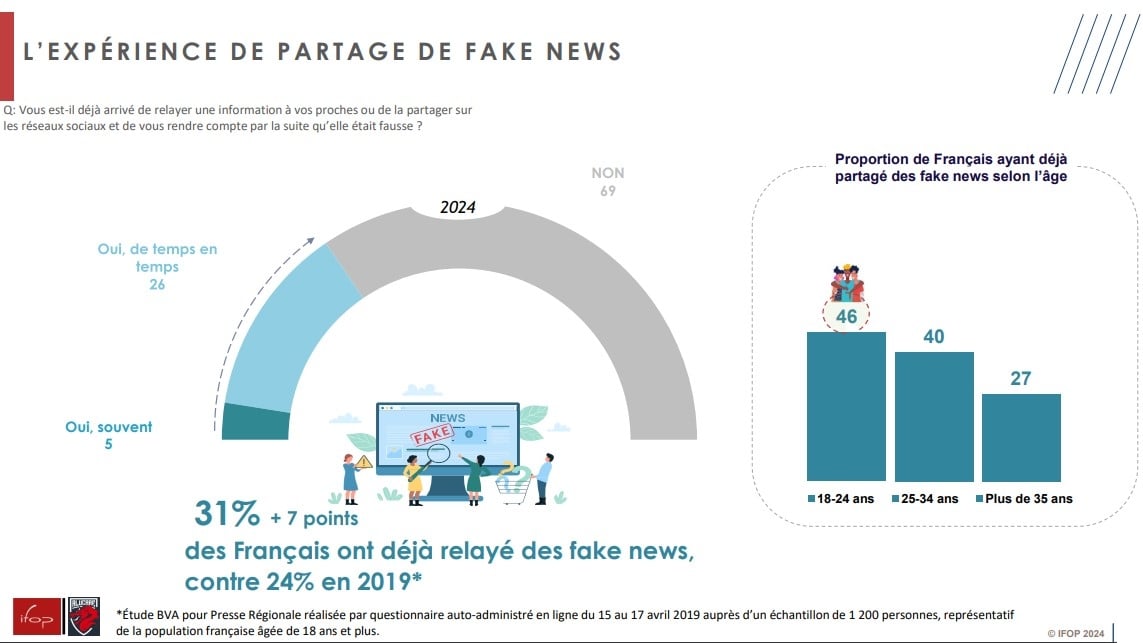

Um em cada três franceses já espalhou notícias falsas

Os deepfakes e as fake news pertencem à mesma família que alimenta a desinformação e a manipulação da opinião pública. Uma manipulação em que alguns franceses admitem participar, mesmo sem querer. E assim é, 31% dos inquiridos (mais 7 pontos do que num estudo do BVA de 2019) já transmitiram às pessoas que os rodeiam informações que mais tarde se provou serem falsas.Os jovens têm mais probabilidades de o ter feito (46%) do que os outros grupos etários. Por outro lado, mais de três quartos das pessoas com mais de 50 anos afirmam nunca o ter feito.

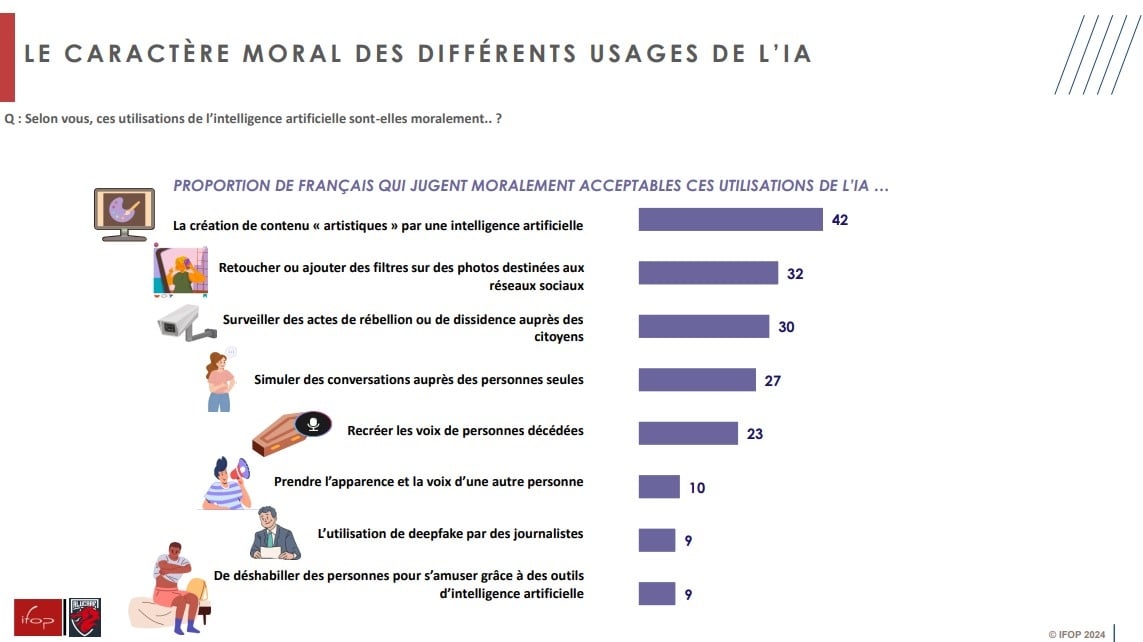

Uma aceitação moral por vezes duvidosa

Como vimos, a inteligência artificial oferece atualmente uma riqueza de recursos em termos de imagens, vídeos e até clonagem de voz. Das várias utilizações da IA que lhes são apresentadas neste inquérito, nenhuma é considerada moralmente aceitável pela maioria dos franceses. Os mais bem aceites são a criação de conteúdos "artísticos" pela inteligência artificial (42% consideram esta prática moralmente aceitável) e o retoque de fotografias nas redes sociais através de filtros (32%).

Mais surpreendente - e certamente mais preocupante - é o facto de 30% dos inquiridos concordam que a IA deve ser utilizada para controlar actos de rebelião ou de dissidência dos cidadãos. Neste caso, os jovens são menos críticos do que os mais velhos: 34% dos jovens com menos de 35 anos consideram esta prática aceitável, contra 29% dos jovens com mais de 35 anos. Existem também grandes diferenças geracionais e de género quando se trata de despir pessoas utilizando a IA para se divertir. Se apenas 91 PT36T dos franceses no seu conjunto não se chocam com esta utilização, este número sobe para 171 PT36T entre os menores de 35 anos (e para 261 PT36T dos homens desta faixa etária), contra 61 PT36T entre os mais velhos. Do mesmo modo, 13% dos homens consideram esta exposição artificial moralmente aceitável, em comparação com 4% das mulheres.

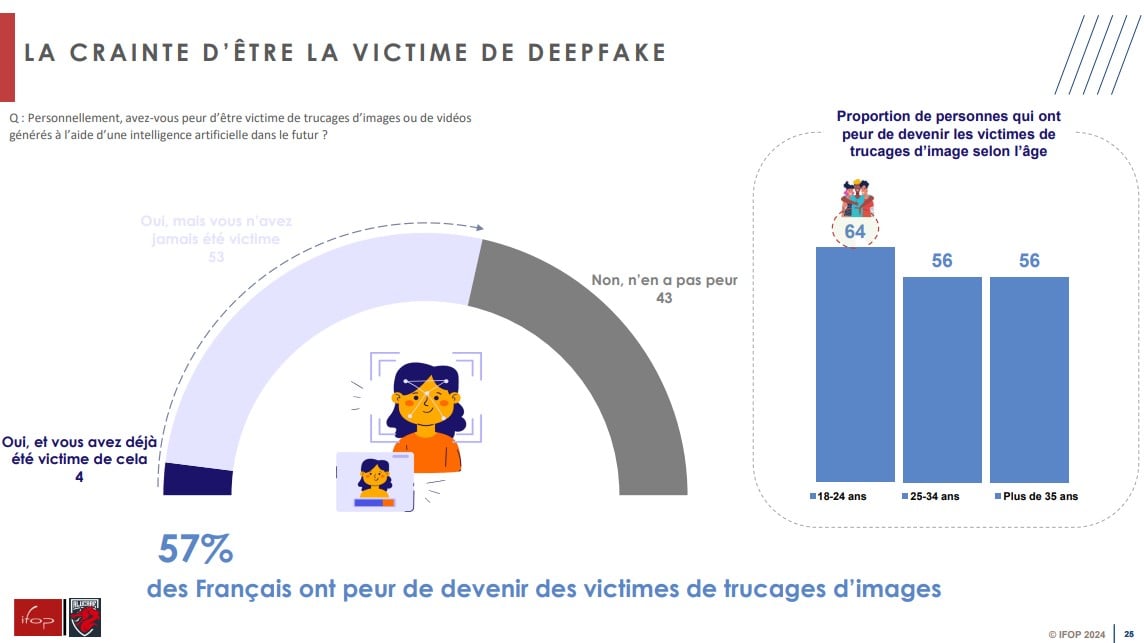

13% de menores de 25 anos foram vítimas de deepfakes

Consciente da utilização generalizada de ferramentas que facilitam a criação de falsificações profundas, mais de metade dos inquiridos (57%) manifestaram o receio de também serem vítimas, o que já aconteceu a 4% deles e a 13% dos menores de 25 anos. Se as faixas etárias mais jovens são, de facto, as mais preocupadas (64% de jovens entre os 18 e os 24 anos receiam imagens falsas de si próprios), as outras faixas etárias não são realmente mais serenas, com 56% de pessoas com mais de 25 anos a manifestarem igualmente preocupação.

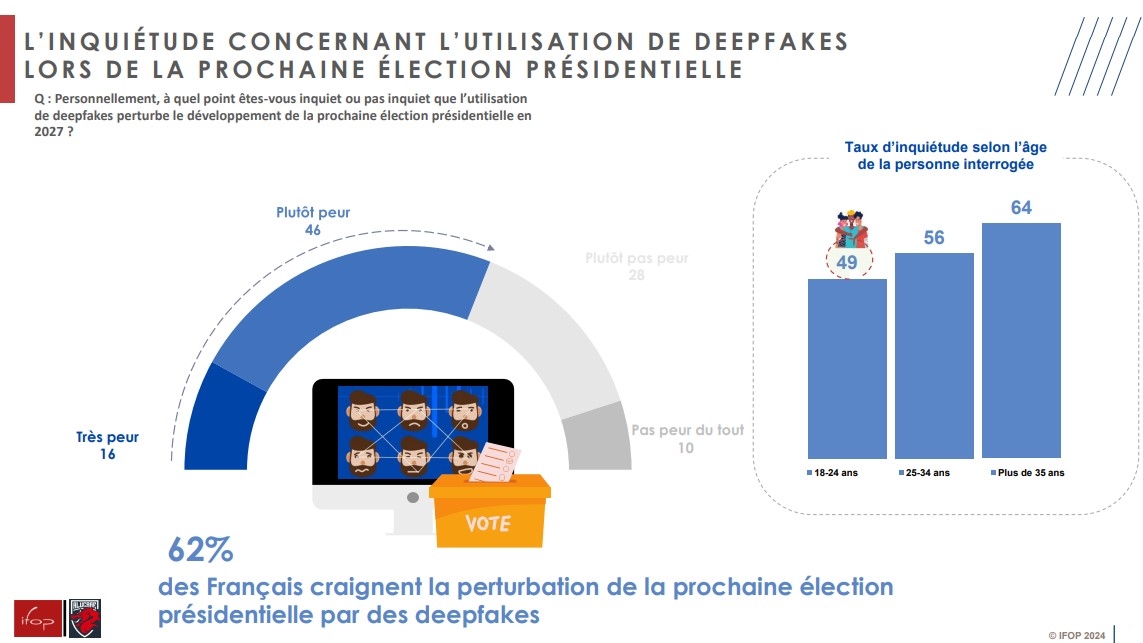

Uma ameaça para a eleição presidencial?

Os franceses temem-nas para si próprios, mas também receiam que essas práticas possam interferir nas próximas eleições presidenciais, tanto mais que as ferramentas de inteligência artificial se tornarão ainda mais poderosas até lá. Mais de 6 em cada 10 franceses (62%) dizem estar preocupados com o facto de os deepfakes poderem perturbar a votação em 2027, incluindo 16% que dizem ter muito medo. Mais preocupados do que a média com a utilização abusiva da sua própria imagem, os jovens estão muito menos preocupados com o potencial impacto de imagens falsas durante a campanha eleitoral: menos de metade (49%) dos jovens com menos de 25 anos receia esta situação, enquanto 70% dos jovens com mais de 65 anos a receiam.

Estudo efectuado pelo IFOP para o Alucare.fr, de 5 a 8 de março de 2024, por questionário auto-administrado junto de uma amostra de 2 191 pessoas, representativa da população francesa com 18 anos ou mais, incluindo 551 jovens com menos de 35 anos.

Na caixa

Deepfakes no projeto de lei SREN

Na terça-feira, 26 de março, uma comissão mista paritária reunindo representantes eleitos da Assembleia Nacional e do Senado analisará o projeto de lei que visa proteger e regular o espaço digital (SREN). Apresentado pelo Governo e aprovado pelos deputados em 17 de outubro de 2023, o projeto tem como objetivo proteger os riscos relacionados ao uso diário da Internet por indivíduos e empresas. Prevê disposições em áreas muito diversas, tais como a proteção online de menores, a proteção dos cidadãos no ambiente digital, o respeito pela concorrência na economia dos dados e o reforço da regulamentação digital. Durante os trabalhos realizados no outono, o Senado acrescentou dois artigos que penalizam a publicação sem consentimento de deepfakes e a publicação de deepfakes de caráter sexual.. As penas podem ir até dois anos de prisão e uma coima de 60 000 euros.