Un sondaggio IFOP esclusivo per Alucare.fr.

Il sondaggio IFOP :

Con i progressi mozzafiato compiuti dall'intelligenza artificiale, il mondo si confronta quotidianamente con i deepfake, immagini e video fittizi straordinariamente realistici che possono essere utilizzati a scopo di intrattenimento, ma anche per campagne di disinformazione e diffamazione su larga scala.

Se molti personaggi pubblici sono regolarmente presi di mira dall'appropriazione indebita della loro immagine, le persone anonime non sono immuni, come è stato dimostrato di recente in Spagna nel caso di ragazze giovanissime vittime di fotomontaggi a sfondo sessuale pubblicati sui social network.

I francesi sono consapevoli di questo fenomeno? Si sentono in grado di affrontarlo? Lo temono per se stessi e per la democrazia?

Per misurarlo, L'Alucare ha commissionato all'IFOP un sondaggio su oltre 2.000 persone. sullo sconvolgimento in atto nel modo in cui percepiamo e percepiremo la realtà in futuro. Le loro risposte riflettono l'incertezza in cui sono immersi da questi formidabili progressi tecnologici, il loro desiderio di identificare chiaramente i contenuti in questione e i loro timori di essere confrontati con essi a titolo personale o durante le prossime elezioni presidenziali.

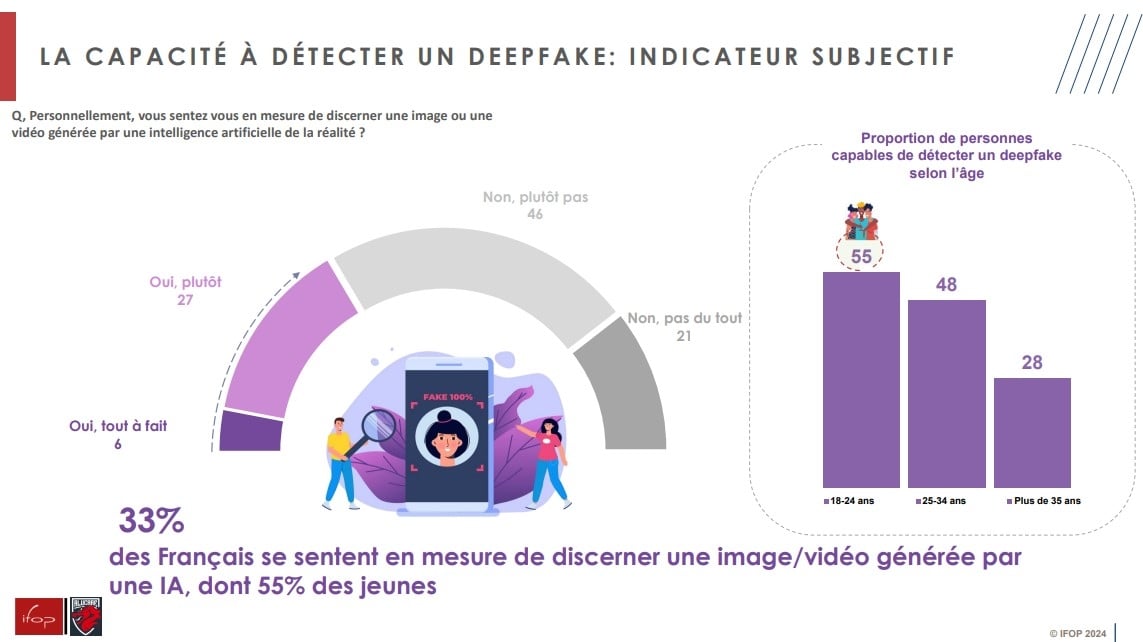

Distinguere la verità dalla falsità: un problema per due terzi dei francesi

Che non siano davvero al passo con le prodezze dell'intelligenza artificiale o che, al contrario, sappiano quanto possa essere potente, solo un terzo (33%) dei francesi si sente in grado di riconoscere un'immagine o un video generato dall'IA. Solo il 6% ne è sicuro, a dimostrazione dell'incertezza che regna nella popolazione sull'argomento. Generalmente più a loro agio con le tecnologie emergenti rispetto agli anziani, i giovani sono quelli che affermano di essere maggiormente in grado di individuare un deepfake: più della metà (55%) dei giovani tra i 18 e i 24 anni afferma che è così, rispetto ai 28% degli over 35 e ai 12% degli over 65. Gli uomini sono anche molto più fiduciosi delle donne nel loro potere di osservazione, con 40% di loro che credono di poter individuare tali immagini rispetto a 28% delle donne..

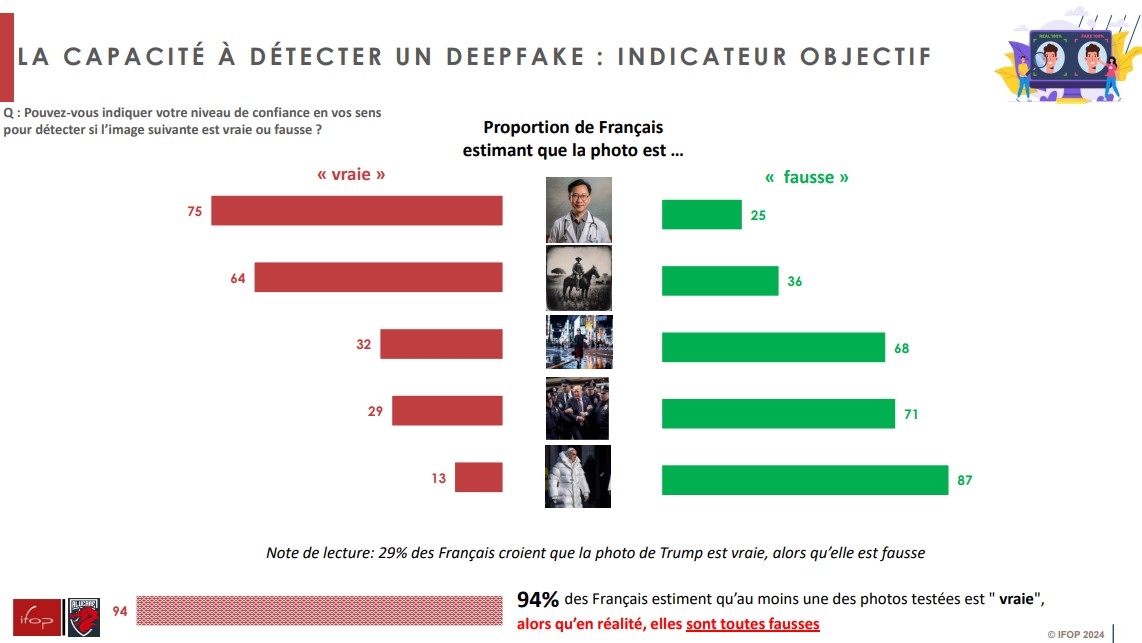

Test: alcune immagini sono più fuorvianti di altre

Il test proposto dall'IFOP illustra perfettamente la difficoltà di distinguere un'immagine prodotta dall'intelligenza artificiale da una foto scattata nella vita reale. I partecipanti, chiamati a esaminare cinque immagini, dovevano indicare quali ritenevano fossero o meno generate dall'intelligenza artificiale. In realtà, tutte le immagini presentate erano "false".

Il ritratto particolarmente realistico di un medico ha ingannato tre quarti (75%) degli intervistati.Quasi due terzi (64%) hanno creduto che una vecchia foto di un uomo a cavallo, tipica delle foto scattate all'inizio del secolo scorso, fosse vera, ma composta interamente dall'IA. D'altra parte, solo 32% hanno creduto alla veridicità di un'immagine di una donna che cammina per le strade di Tokyo, un'immagine ampiamente utilizzata da Open AI per annunciare il rilascio del suo generatore di video Sora. L'ex presidente Donald Trump, regolarmente al centro delle cronache per i suoi scontri con la giustizia statunitense, è stato mostrato circondato da diversi agenti di polizia. Questa "foto" è stata ritenuta credibile da più di un francese su quattro (29%), con un numero leggermente superiore di donne (32%) che credono nella sua autenticità rispetto agli uomini (27%). Infine, l'immagine di Papa Francesco con un piumino bianco, ampiamente pubblicata sui social network qualche mese fa, ha ingannato solo 13% degli intervistati. Infine, 94% degli intervistati credevano nella veridicità di almeno uno dei cliché sottoposti al loro esame.

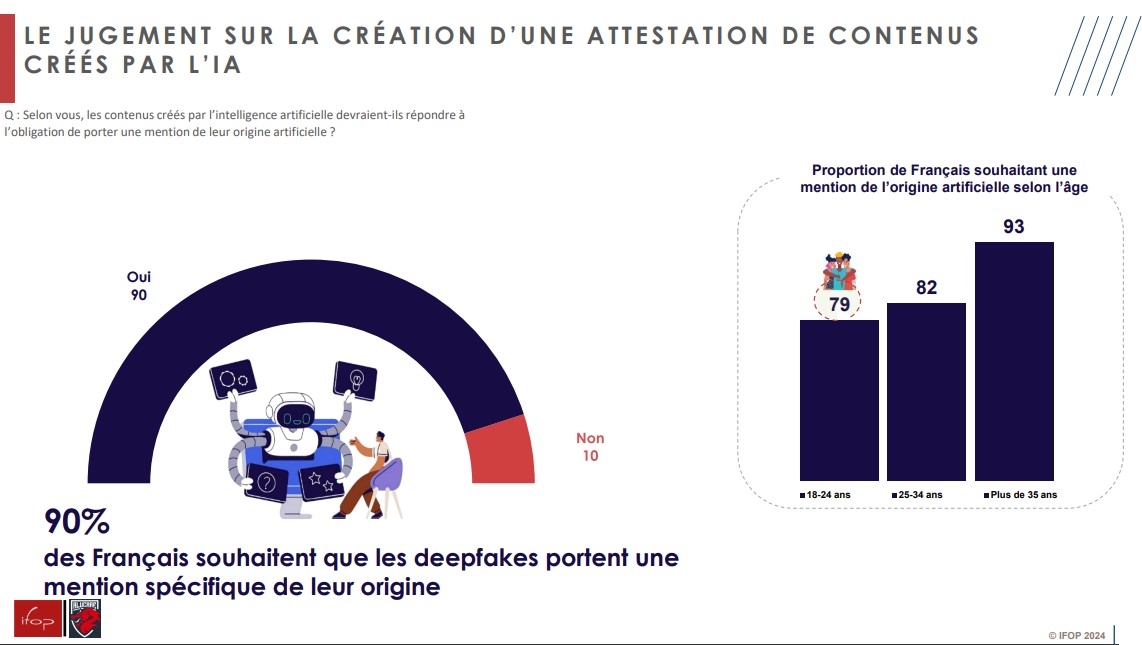

90% del francese per una menzione di origine

Ovviamente ha messo in guardia dai rischi di disinformazione insiti nella propagazione di immagini del tutto realistiche prodotte dall'IA, la stragrande maggioranza (90%) dei francesi è a favore di una dichiarazione che identifichi i deepfake come se fosse stato creato artificialmente. Questa aspettativa è più alta tra gli over 35 (93% sono favorevoli) che tra i più giovani (79% tra i 18-24enni).

Indizi non sempre facili da individuare

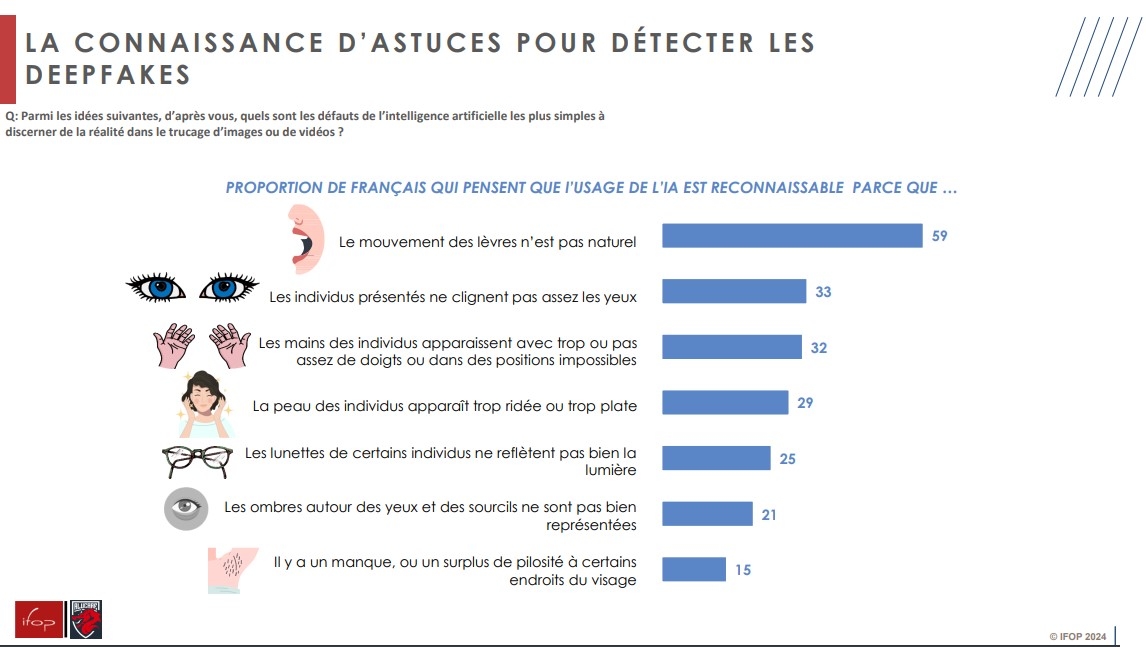

Nel giro di pochi anni, o addirittura di pochi mesi per alcuni, gli strumenti di intelligenza artificiale hanno fatto progressi impressionanti nel rendere le produzioni visive sempre più realistiche. Tuttavia, ci sono ancora alcuni dettagli che possono tradire la loro vera natura, anche se i francesi rimangono cauti su molti di essi. Per 59% dei francesi, il movimento innaturale delle labbra di un personaggio che parla in un video è un indizio che ritengono abbastanza facile da individuare.. Allo stesso modo, il fatto che gli individui rappresentati non sbattano le palpebre abbastanza spesso è un buon indicatore per un terzo (33%) dei francesi.

In una proporzione simile, 32% sottolineano le difficoltà, note ma sempre meno attuali, dell'IA che genera immagini nel riprodurre correttamente le mani. La pelle rugosa o troppo piatta (29%), gli occhiali che non riflettono correttamente la luce (25%), le ombre intorno agli occhi non sufficientemente precise (21%) o la mancanza di capelli in alcune zone del viso (15%) sono tutte imperfezioni considerate potenziali segnali di allarme. Tuttavia, solo una minoranza degli intervistati li considera facili da individuare.

Conoscenza parziale dei deepfakes

Dalla cantante Taylor Swift, vittima di deepfakes pornografici all'inizio dell'anno, al falso annuncio del presidente Volodimir Zelensky sulla resa delle truppe ucraine, fino alla recentissima dichiarazione di Ursula von der Leyen, anch'essa falsa, sulle prossime elezioni europee, i video generati dall'intelligenza artificiale con persone reali si stanno moltiplicando. E non si tratta solo di celebrità e politici: lo scorso settembre ad Almendralejo, in Spagna, quasi trenta ragazzine tra gli 11 e i 17 anni sono state prese di mira da deepfakes che le mostravano nude.

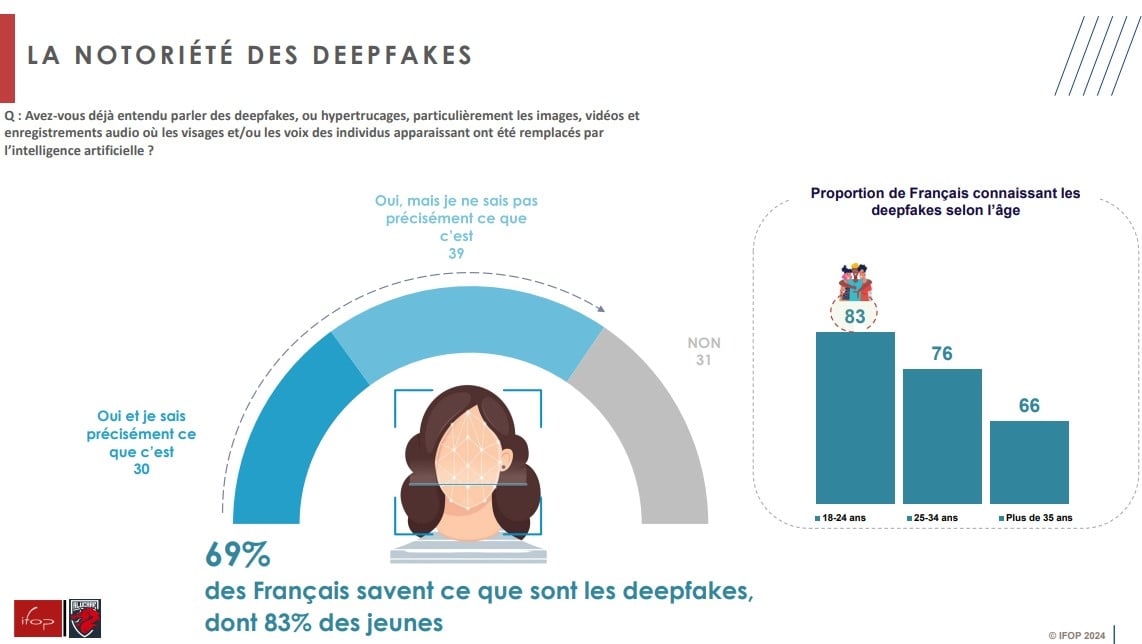

Di fronte a questo fenomeno crescente e preoccupante, quasi 7 francesi su 10 (69%) dichiarano di aver già sentito parlare dei deepfake, ma solo il 30% sa esattamente di cosa si tratta. Ancora una volta, sono le giovani generazioni ad essere più informate su questo fenomeno: 83% dei giovani tra i 18 e i 24 anni (rispetto ai 66% degli over 35) ne sono consapevoli e 50% (rispetto ai 15% degli over 65) ne hanno una visione chiara.. Il divario tra donne e uomini non è insignificante: mentre 24% delle donne sanno chiaramente cosa sono i deepfakes, 37% degli uomini lo sanno.

Un francese su tre ha già diffuso fake news

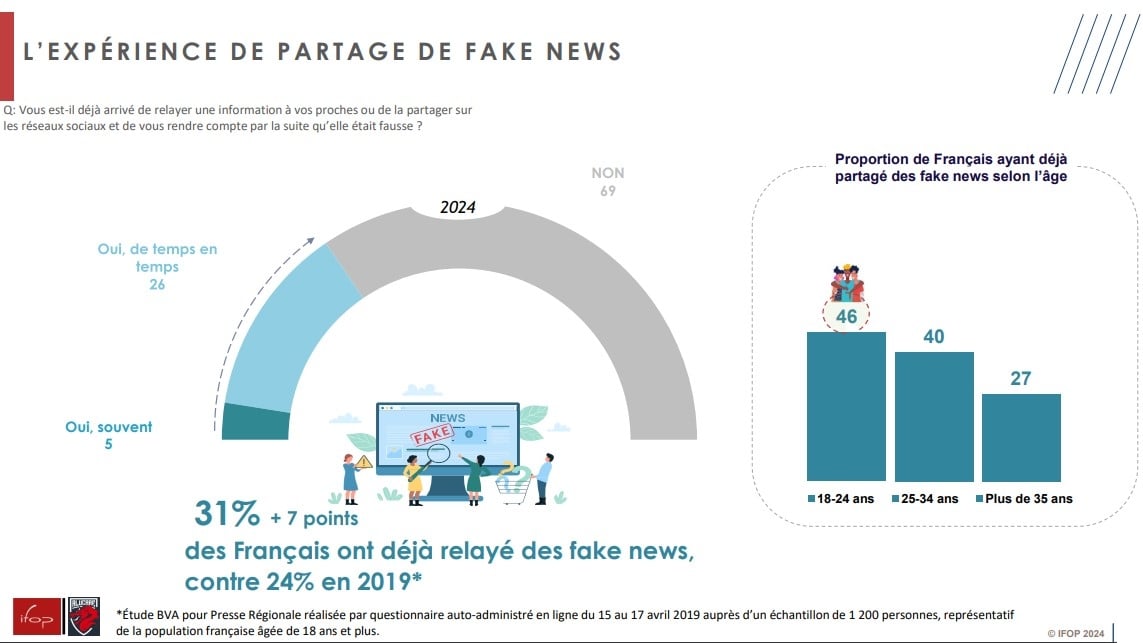

Deepfakes e fake news appartengono alla stessa famiglia che alimenta la disinformazione e la manipolazione dell'opinione pubblica. Una manipolazione alla quale alcuni francesi ammettono di partecipare, anche inconsapevolmente. E così è, 31% degli intervistati (7 punti in più rispetto a uno studio BVA del 2019) ha già trasmesso a chi li circonda informazioni che poi si sono rivelate false.I giovani sono più propensi a farlo (46%) rispetto agli altri gruppi di età. D'altra parte, più di tre quarti degli over 50 dichiarano di non averlo mai fatto.

Un'accettazione morale a volte dubbia

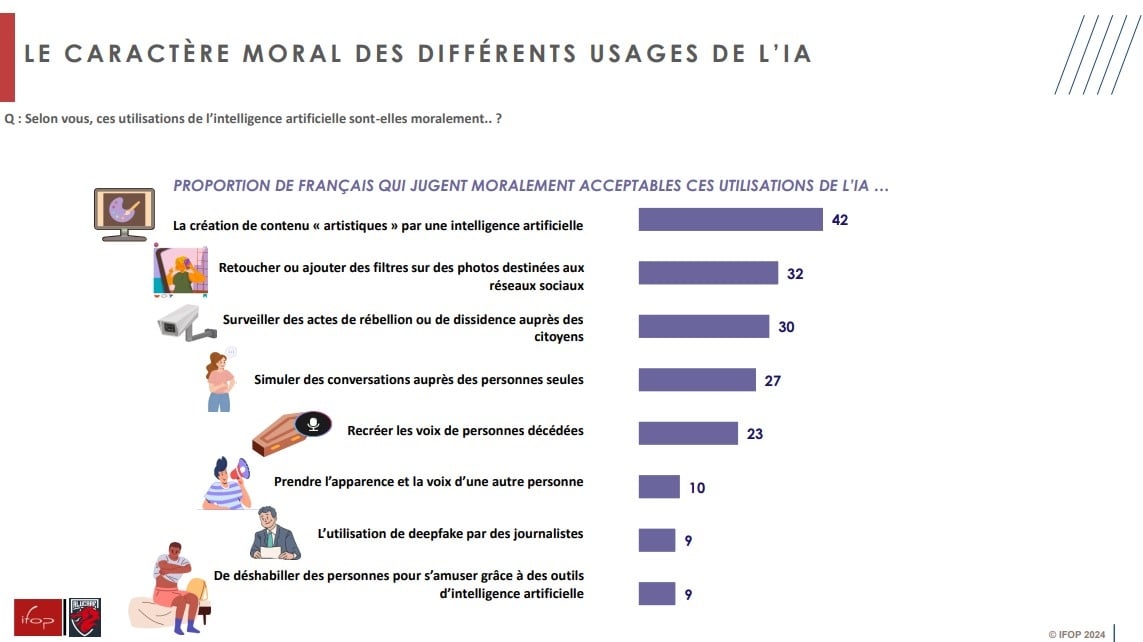

Come abbiamo visto, l'intelligenza artificiale offre oggi una grande quantità di risorse in termini di immagini, video e persino clonazioni vocali. Dei vari usi dell'IA presentati in questo sondaggio, nessuno è ritenuto moralmente accettabile dalla maggioranza dei francesi. I più accettati sono la creazione di contenuti "artistici" da parte dell'intelligenza artificiale (42% lo ritengono moralmente accettabile) e il ritocco delle foto sui social network tramite filtri (32%).

Ancora più sorprendente - e certamente più preoccupante - è il fatto che 30% degli intervistati concorda sul fatto che l'IA debba essere utilizzata per monitorare gli atti di ribellione o di dissenso dei cittadini.. In questo caso, i giovani sono meno critici dei loro anziani: 34% degli under 35 ritengono accettabile questa pratica, contro 29% degli over 35. Ci sono anche grandi differenze generazionali e di genere quando si tratta di spogliare le persone usando l'IA per divertimento. Mentre solo il 9% dei francesi nel complesso non si scandalizza per tale uso, la cifra sale a 17% tra i minori di 35 anni (e ben 26% degli uomini in questa fascia d'età) rispetto al 6% dei più anziani. Allo stesso modo, 13% degli uomini considerano questa esposizione artificiale moralmente accettabile, rispetto a 4% delle donne.

13% degli under 25 sono stati vittime di deepfakes

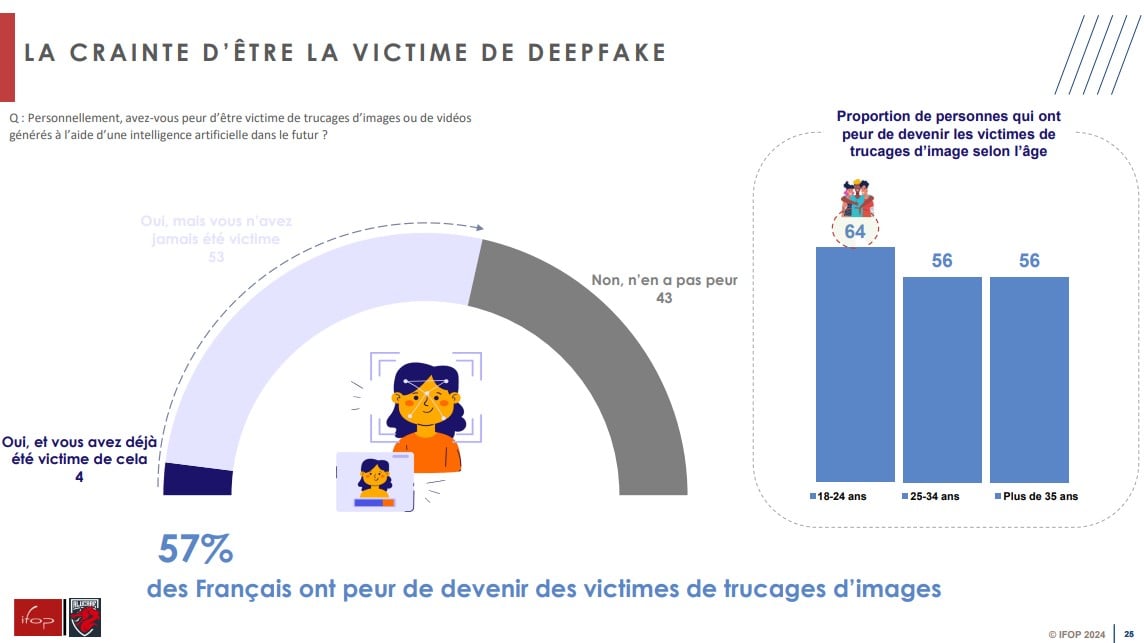

Consapevoli dell'uso diffuso di strumenti che facilitano la creazione di deepfakes, più della metà degli intervistati (57%) ha espresso il timore di essere anch'essi vittime, cosa che è già accaduta a 4% di loro e a 13% dei minori di 25 anniSe le fasce d'età più giovani sono effettivamente le più preoccupate (64% dei 18-24enni temono immagini false di loro), le altre fasce d'età non sono in realtà più serene, con 56% degli over 25 che esprimono preoccupazione.

Una minaccia per le elezioni presidenziali?

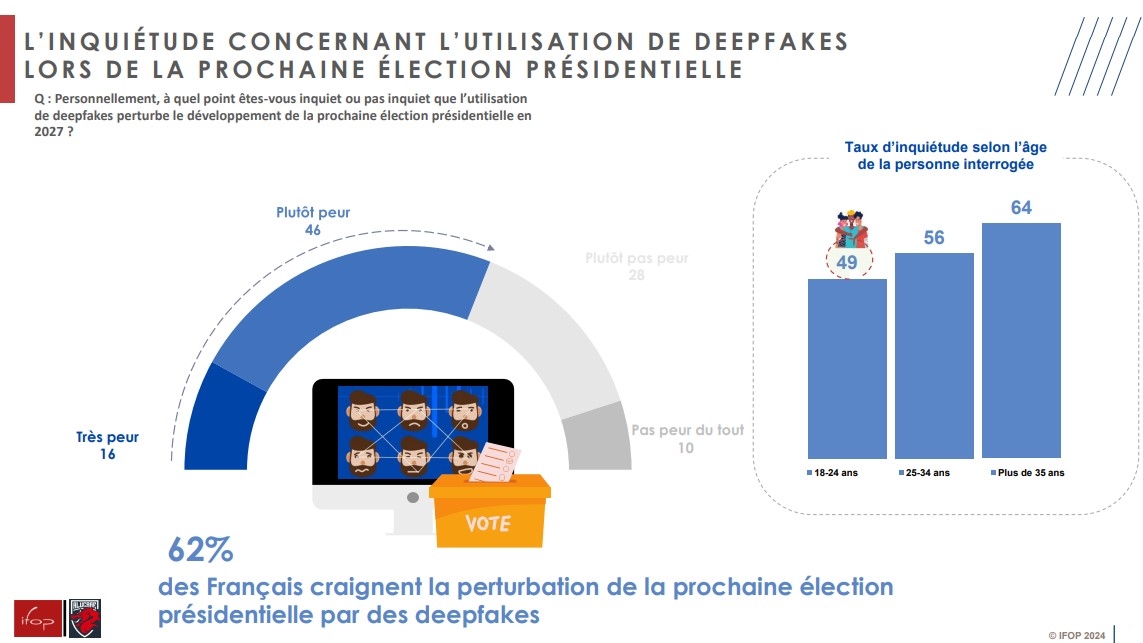

Se da un lato li temono per se stessi, dall'altro i francesi temono che tali pratiche possano interferire con le prossime elezioni presidenziali, soprattutto perché è certo che gli strumenti di intelligenza artificiale diventeranno ancora più potenti da qui ad allora. Più di 6 francesi su 10 (62%) dichiarano di essere preoccupati che i deepfakes possano disturbare il voto del 2027, tra cui 16% che dichiarano di avere molta paura. Più preoccupati della media per l'uso improprio della propria immagine, i giovani sono molto meno preoccupati per il potenziale impatto di immagini false durante la campagna elettorale: meno della metà (49%) dei giovani sotto i 25 anni lo teme, mentre 70% degli over 65 lo teme.

Studio condotto da IFOP per Alucare.fr dal 5 all'8 marzo 2024 mediante questionario autosomministrato su un campione di 2.191 persone, rappresentativo della popolazione francese di età pari o superiore a 18 anni, compresi 551 giovani sotto i 35 anni.

Nella confezione

Falsi profondi nel disegno di legge SREN

Martedì 26 marzo, una commissione mista paritetica composta da membri dell'Assemblea nazionale e del Senato esaminerà il disegno di legge volto a garantire la sicurezza e la regolamentazione dello spazio digitale (SREN). Presentato dal governo e adottato dai deputati il 17 ottobre 2023, il disegno di legge mira a garantire la sicurezza dei rischi legati all'uso quotidiano di Internet per i privati e le imprese. Prevede disposizioni in settori molto diversi, quali la protezione online dei minori, la protezione dei cittadini nell'ambiente digitale, il rispetto della concorrenza nell'economia dei dati e il rafforzamento della regolamentazione del digitale. Durante i lavori svolti in autunno, il Senato ha aggiunto due articoli che puniscono la pubblicazione senza consenso di deepfake e la pubblicazione di deepfake a carattere sessuale.. Le sanzioni possono arrivare fino a due anni di reclusione e 60.000 euro di multa.