Una encuesta exclusiva de IFOP para Alucare.fr.

La encuesta IFOP :

Con los asombrosos avances de la inteligencia artificial, el mundo se enfrenta a diario a deepfakes, imágenes y vídeos ficticios sorprendentemente realistas que pueden utilizarse con fines de entretenimiento, pero también para campañas de desinformación y desprestigio a gran escala.

Aunque muchas figuras públicas son blanco habitual de la apropiación indebida de su imagen, las personas anónimas no son inmunes, como se ha demostrado recientemente en España en el caso de chicas muy jóvenes que fueron víctimas de montajes fotográficos de contenido sexual publicados en las redes sociales.

¿Son conscientes los franceses de este fenómeno? ¿Se sienten capaces de afrontarlo? ¿Lo temen por sí mismos y por la democracia?

Para medirlo, Alucare encargó al IFOP una encuesta a más de 2.000 personas. sobre el cambio que se está produciendo en la forma en que percibimos y percibiremos la realidad en el futuro. Sus respuestas reflejan la incertidumbre en la que les sumergen estos formidables avances tecnológicos, su deseo de identificar claramente los contenidos en cuestión y su temor a enfrentarse a ellos personalmente o durante las próximas elecciones presidenciales.

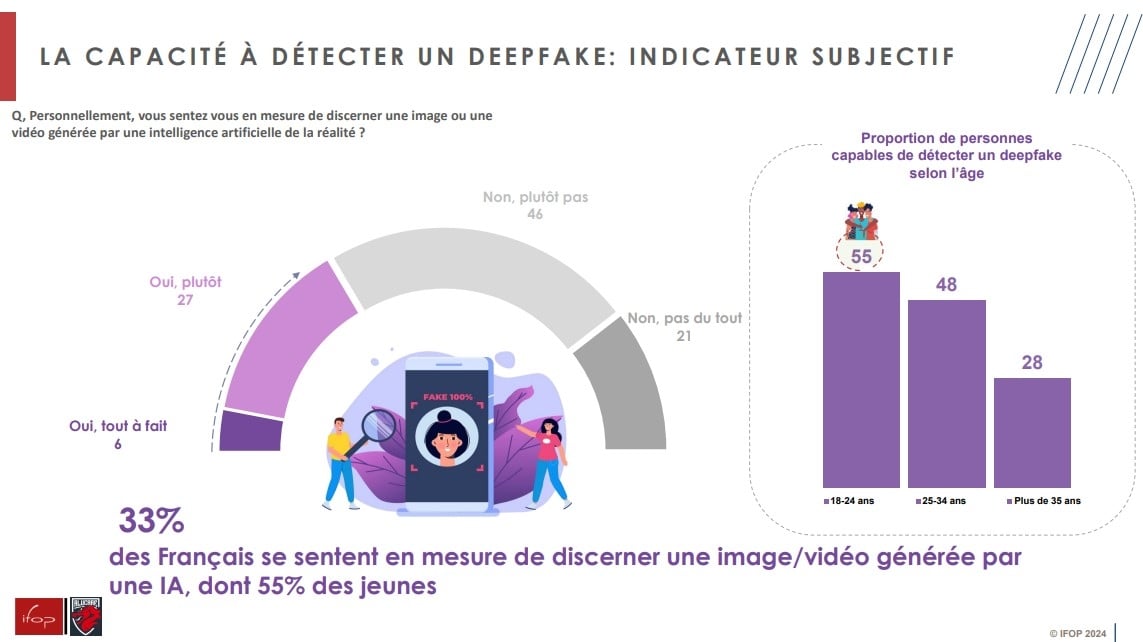

Distinguir la verdad de la mentira: un problema para dos tercios de los franceses

Si no están realmente al corriente de las proezas de la inteligencia artificial o, por el contrario, saben lo poderosa que puede llegar a ser, sólo un tercio (33%) de los franceses se siente capaz de detectar una imagen o un vídeo generado por IA. Sólo 6% están seguros de ello, lo que demuestra la incertidumbre que reina en la población al respecto. Los jóvenes, que en general se sienten más cómodos con las nuevas tecnologías que sus mayores, son los que afirman ser más capaces de detectar un deepfake: más de la mitad (55%) de los jóvenes de 18 a 24 años así lo afirman, frente a 28% de los mayores de 35 años y 12% de los mayores de 65 años. Los hombres también confían mucho más que las mujeres en su capacidad de observación: 40% de ellos creen que pueden detectar esas imágenes, frente a 28% de las mujeres..

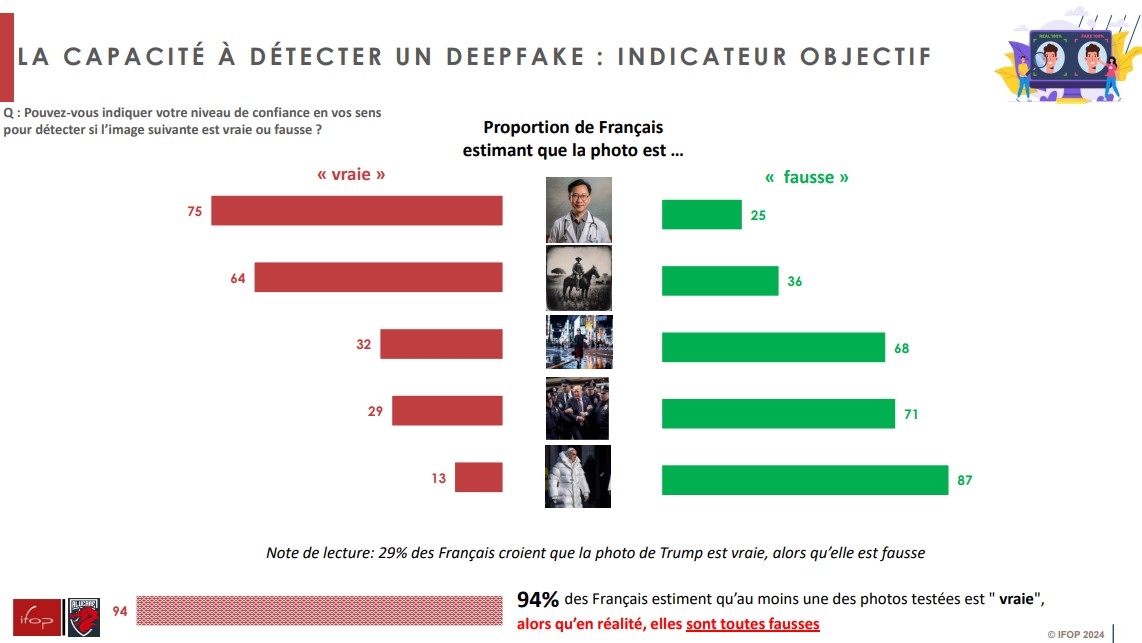

Prueba: algunas imágenes son más engañosas que otras

La prueba propuesta por el IFOP ilustra perfectamente la dificultad de distinguir una imagen producida por la inteligencia artificial de una foto tomada en la vida real. Se pidió a los participantes que examinaran cinco imágenes e indicaran cuáles creían que habían sido generadas o no por la IA. Pero en realidad, todas las imágenes presentadas eran "falsas".

El retrato especialmente realista de un médico engañó a tres cuartas partes (75%) de los encuestados.Casi dos tercios (64%) creyeron en la veracidad de una foto antigua de un hombre a caballo, típica de las fotos tomadas a principios del siglo pasado, pero compuesta íntegramente por IA. Por otro lado, solo 32% creyeron en la veracidad de una imagen de una mujer caminando por las calles de Tokio, imagen ampliamente utilizada por Open AI para anunciar el lanzamiento de su generador de vídeo Sora. El expresidente Donald Trump, habitual en las noticias por sus encontronazos con la justicia estadounidense, aparecía rodeado de varios policías. Esta "foto" fue considerada creíble por más de uno de cada cuatro franceses (29%), siendo ligeramente más las mujeres (32%) las que creyeron en su autenticidad que los hombres (27%). Por último, la imagen del Papa Francisco con un plumífero blanco, ampliamente difundida en las redes sociales hace unos meses, sólo engañó a 13% de los interrogados. Por último, 94% de los encuestados creían en la veracidad de al menos uno de los tópicos sometidos a su escrutinio.

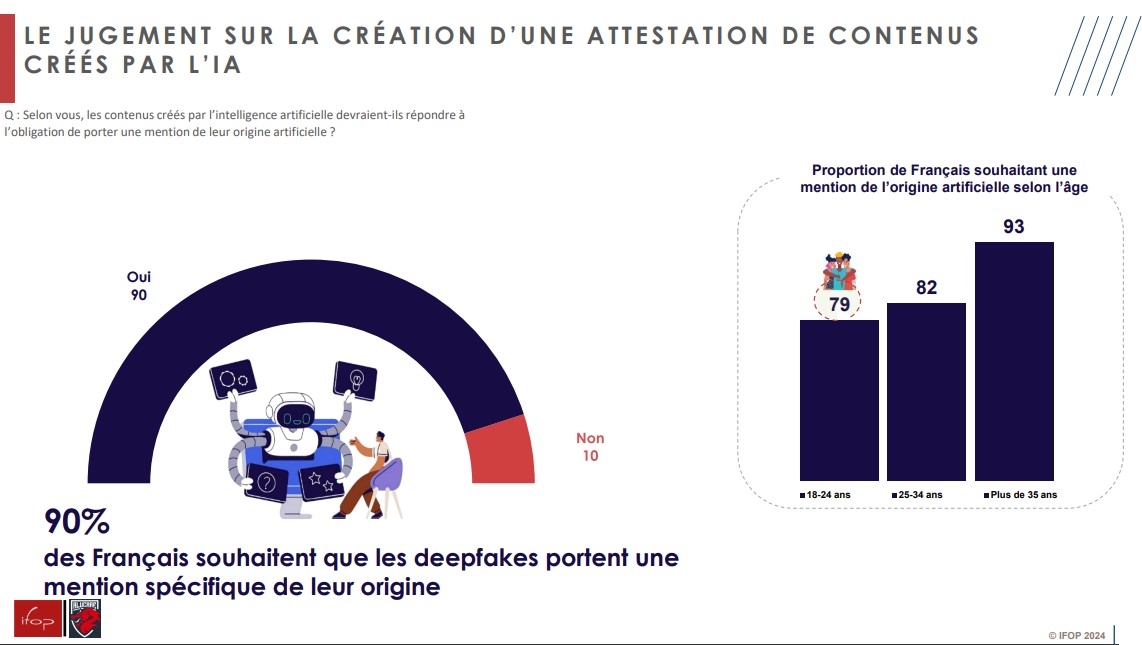

90% del francés para una mención de origen

Obviamente, advirtió de los riesgos de desinformación inherentes a la propagación de imágenes totalmente realistas producidas por IA, la inmensa mayoría (90%) de los franceses está a favor de una declaración que identifique los deepfakes como creadas artificialmente. Esta expectativa es mayor entre los mayores de 35 años (93% están a favor) que entre sus homólogos más jóvenes (79% entre 18-24 años).

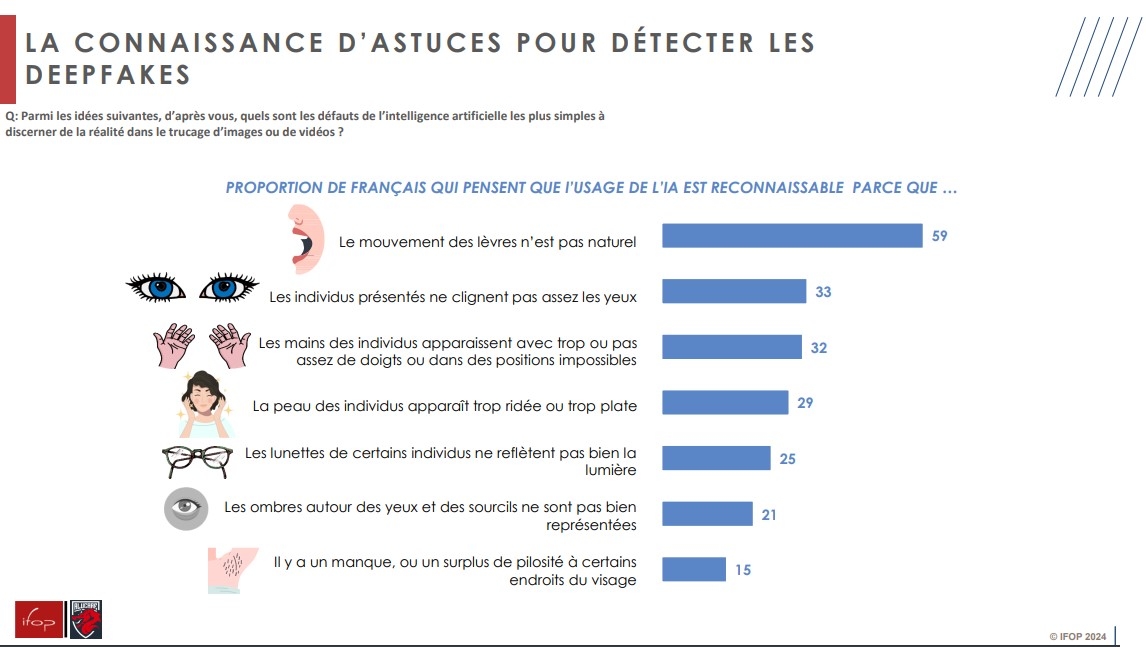

Pistas que no siempre son fáciles de detectar

En el espacio de unos pocos años, o incluso de unos pocos meses para algunos, las herramientas de inteligencia artificial han hecho progresos impresionantes para que sus producciones visuales sean cada vez más realistas. Sin embargo, algunos detalles pueden seguir delatando su verdadera naturaleza, aunque los franceses sigan siendo circunspectos sobre muchos de ellos. Para 59% de los franceses, el movimiento antinatural de los labios de un personaje que habla en un vídeo es una pista que consideran bastante fácil de detectar.. Del mismo modo, el hecho de que los individuos representados no parpadeen con suficiente frecuencia es un buen indicador para un tercio (33%) de los franceses.

En una proporción similar, 32% señalan las dificultades, conocidas pero cada vez menos actuales, de las IA generadoras de imágenes para reproducir correctamente las manos. La piel arrugada o demasiado plana (29%), las gafas que no reflejan correctamente la luz (25%), las sombras alrededor de los ojos que no son lo suficientemente precisas (21%) o la falta de vello en determinadas zonas de la cara (15%) son imperfecciones consideradas como posibles señales de alarma. Sin embargo, sólo una minoría de los encuestados considera que son fáciles de detectar.

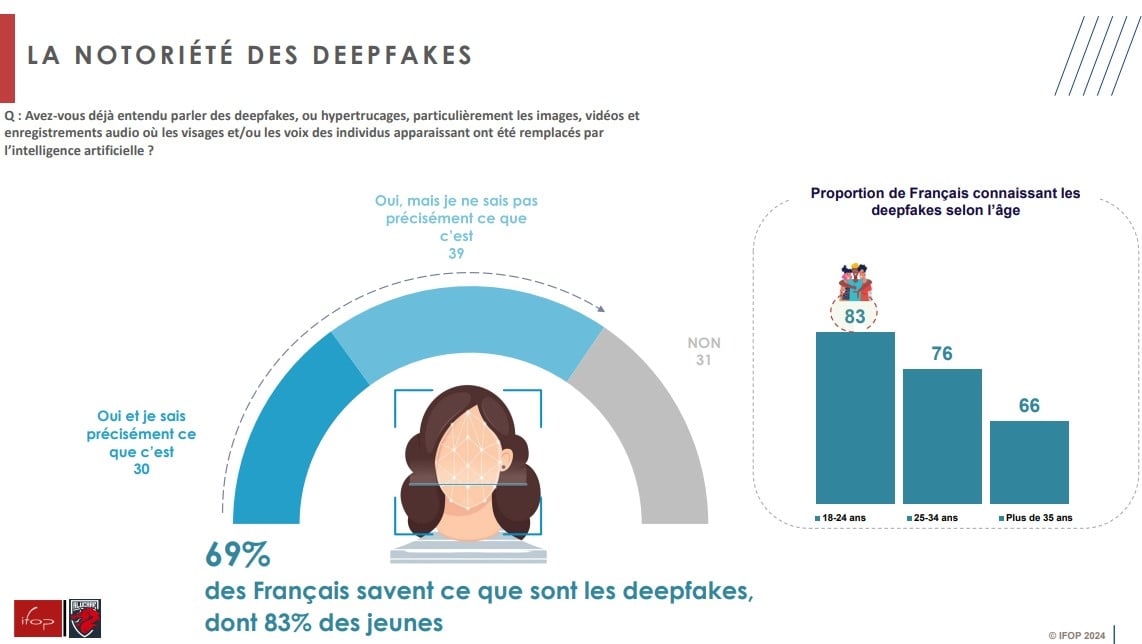

Conocimiento parcial de los deepfakes

Desde la cantante Taylor Swift, víctima de deepfakes pornográficos a principios de este año, pasando por el falso anuncio del presidente Volodimir Zelensky sobre la rendición de las tropas ucranianas, hasta la muy reciente declaración, también falsa, de Ursula von der Leyen sobre las próximas elecciones europeas, los vídeos generados por IA en los que aparecen personas reales se multiplican. Y no sólo los famosos y los políticos se ven afectados: el pasado mes de septiembre, en Almendralejo (España), casi una treintena de niñas de entre 11 y 17 años fueron blanco de deepfakes que las mostraban desnudas.

Ante este fenómeno creciente y preocupante, casi 7 de cada 10 franceses (69%) afirman haber oído hablar de los deepfakes, pero solo 30% saben exactamente de qué se trata. Una vez más, son las generaciones más jóvenes las que están más al tanto de este movimiento: 83% de los jóvenes de 18 a 24 años (frente a 66% de los mayores de 35 años) la conocen y 50% (frente a 15% de los mayores de 65 años) tienen una visión clara de ella.. La diferencia entre mujeres y hombres no es insignificante: mientras que 24% de las mujeres saben claramente lo que son los deepfakes, 37% de los hombres sí lo saben.

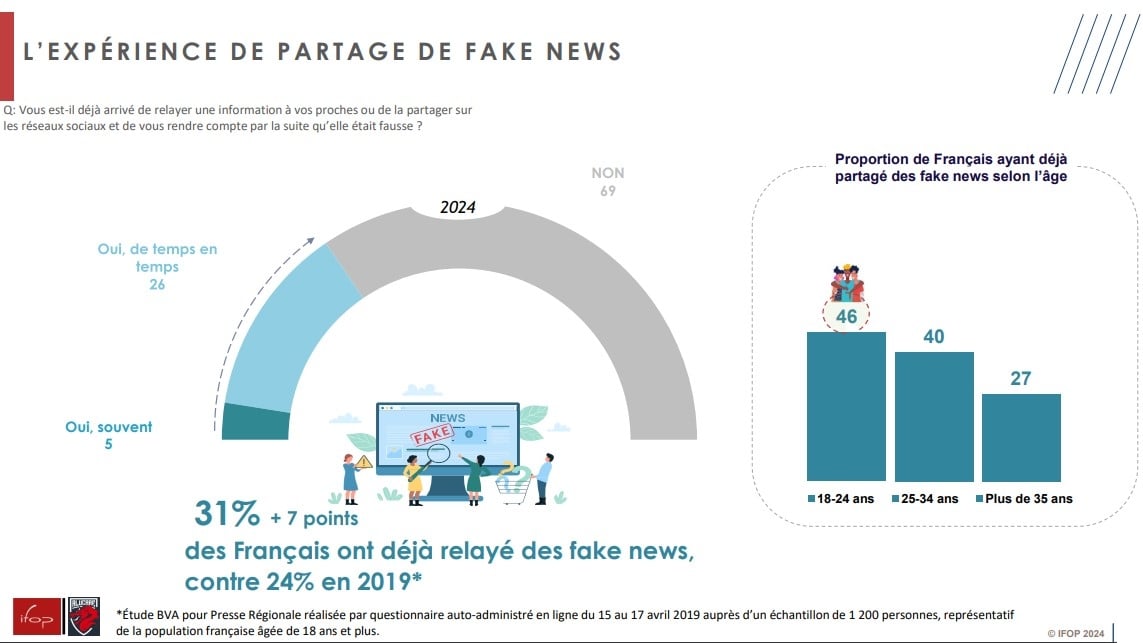

Uno de cada tres franceses ya ha difundido noticias falsas

Los deepfakes y las fake news pertenecen a la misma familia que alimenta la desinformación y la manipulación de la opinión pública. Una manipulación en la que algunos franceses admiten participar, incluso sin saberlo. Y así es, 31% de los encuestados (7 puntos más que en un estudio de BVA de 2019) ya han transmitido a su entorno información que luego se ha demostrado falsa.Los jóvenes tienen más probabilidades de haberlo hecho (46%) que los demás grupos de edad. En cambio, más de tres cuartas partes de los mayores de 50 años afirman no haberlo hecho nunca.

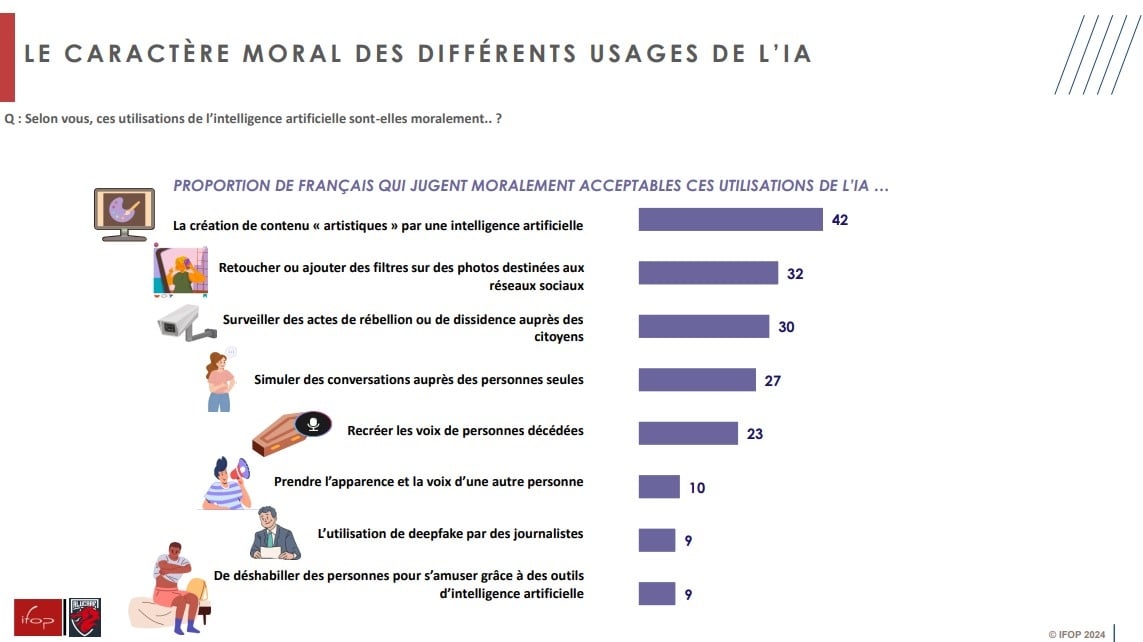

Una aceptación moral a veces dudosa

Como hemos visto, la inteligencia artificial proporciona hoy en día una gran cantidad de recursos en términos de imágenes, vídeo e incluso clonación de la voz. De los diversos usos de la IA que se les presentan en esta encuesta, ninguno es considerado moralmente aceptable por la mayoría de los franceses. Los mejor aceptados son la creación de contenidos "artísticos" mediante inteligencia artificial (42% lo consideran moralmente aceptable) y el retoque de fotos en redes sociales mediante filtros (32%).

Más sorprendente -y sin duda más preocupante- es el hecho de que 30% de los encuestados están de acuerdo en que la IA debe utilizarse para vigilar los actos de rebelión o disidencia de los ciudadanos.. Los jóvenes son menos críticos con esta práctica que sus mayores: 34% de los menores de 35 años la consideran aceptable, frente a 29% de los mayores de 35 años. También hay grandes diferencias generacionales y de género a la hora de desnudar a la gente utilizando la IA para divertirse. Mientras que sólo 9% de los franceses en su conjunto no se escandalizan por este uso, la cifra se eleva a 17% entre los menores de 35 años (y hasta 26% de los hombres de esta franja de edad) frente a 6% entre sus mayores. Del mismo modo, 13% de los hombres consideran que esta exposición artificial es moralmente aceptable, frente a 4% de las mujeres.

13% de los menores de 25 años han sido víctimas de deepfakes

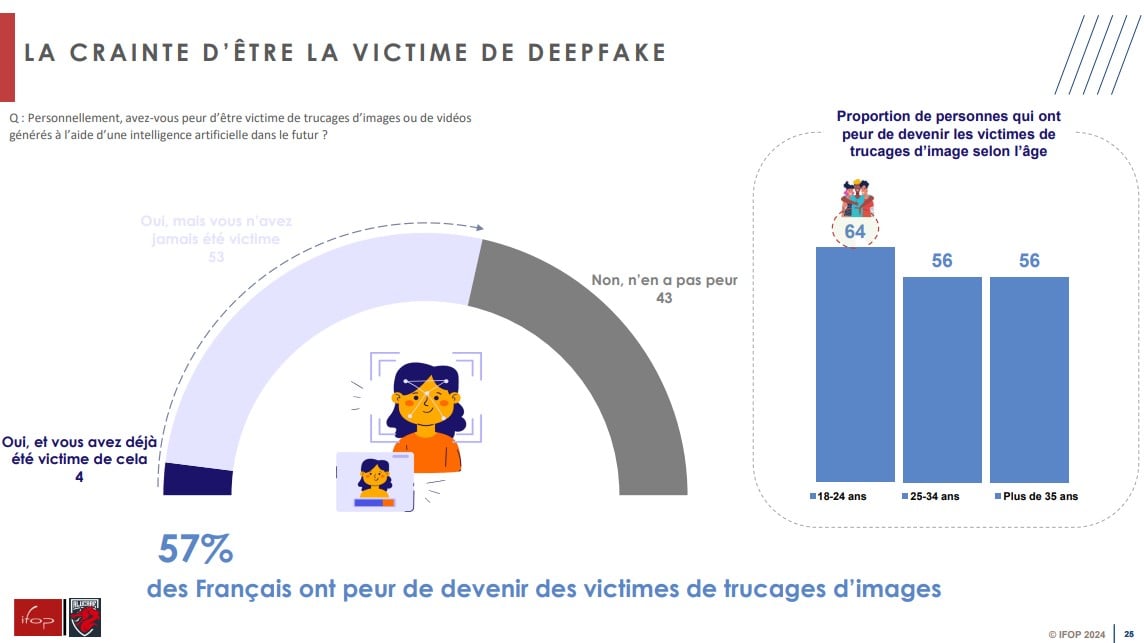

Consciente del uso generalizado de herramientas que facilitan la creación de deepfakes, más de la mitad de los encuestados (57%) expresaron su temor a ser ellos también víctimas, algo que ya les había ocurrido a 4% de ellos y a 13% de los menores de 25 años. Si bien es cierto que los grupos de edad más jóvenes son los más preocupados (64% de los jóvenes de 18 a 24 años temen las imágenes falsas de ellos), los demás grupos de edad no están realmente más serenos, ya que 56% de los mayores de 25 años también expresan su preocupación.

¿Una amenaza para las elecciones presidenciales?

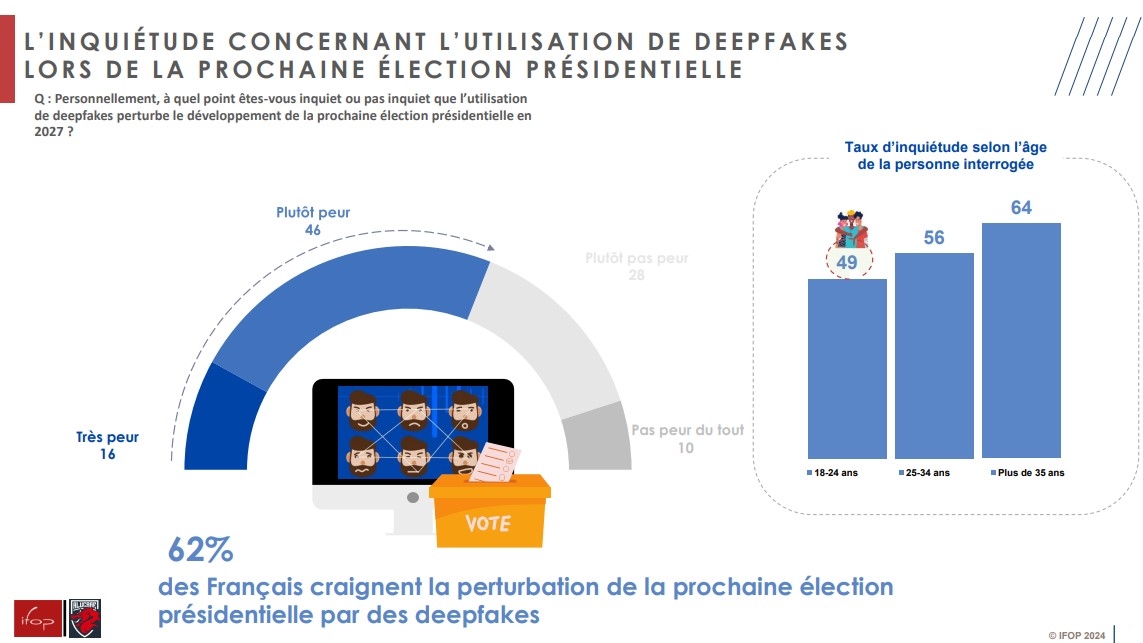

Aunque las temen por sí mismos, los franceses también temen que tales prácticas puedan interferir en las próximas elecciones presidenciales, sobre todo teniendo en cuenta que las herramientas de inteligencia artificial seguramente serán aún más potentes de aquí a entonces. Más de 6 de cada 10 franceses (62%) dicen estar preocupados de que los deepfakes puedan perturbar el voto en 2027, incluyendo 16% que dicen tener mucho miedo. Más preocupados que la media por el mal uso de su propia imagen, los jóvenes están mucho menos preocupados por el impacto potencial de las imágenes falsas durante la campaña electoral: menos de la mitad (49%) de los menores de 25 años lo temen, mientras que 70% de los mayores de 65 años lo temen.

Estudio realizado por el IFOP para Alucare.fr del 5 al 8 de marzo de 2024 mediante cuestionario autoadministrado entre una muestra de 2.191 personas, representativa de la población francesa de 18 años o más, incluidos 551 jóvenes menores de 35 años.

En la caja

Deepfakes en el proyecto de ley SREN

El martes 26 de marzo, una comisión mixta paritaria formada por diputados de la Asamblea Nacional y del Senado estudiará el proyecto de ley destinado a proteger y regular el espacio digital (SREN). Presentado por el Gobierno y aprobado por los diputados el 17 de octubre de 2023, su objetivo es proteger contra los riesgos relacionados con el uso diario de Internet por parte de particulares y empresas. Prevé disposiciones en ámbitos muy diversos, como la protección en línea de los menores, la protección de los ciudadanos en el entorno digital, el respeto de la competencia en la economía de los datos y el refuerzo de la regulación digital. Durante sus trabajos en otoño, el Senado añadió dos artículos que penalizan la publicación sin consentimiento de hiperfalsificaciones (deepfakes) y la publicación de deepfakes de carácter sexual.. Las penas podrían ser de hasta dos años de prisión y 60.000 euros de multa.